论文标题:EasyQuant: Post-training Quantization via Scale Optimization

论文链接:https://arxiv.org/pdf/2006.16669.pdf

代码链接:https://github.com/deepglint/EasyQuant

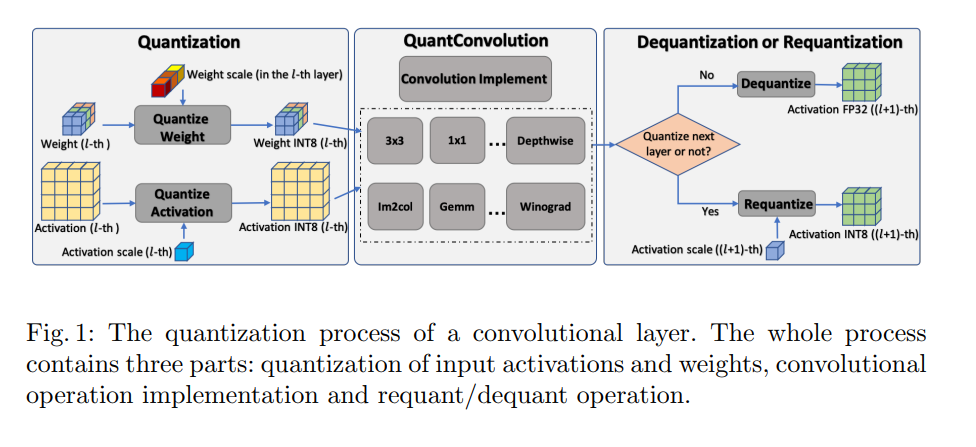

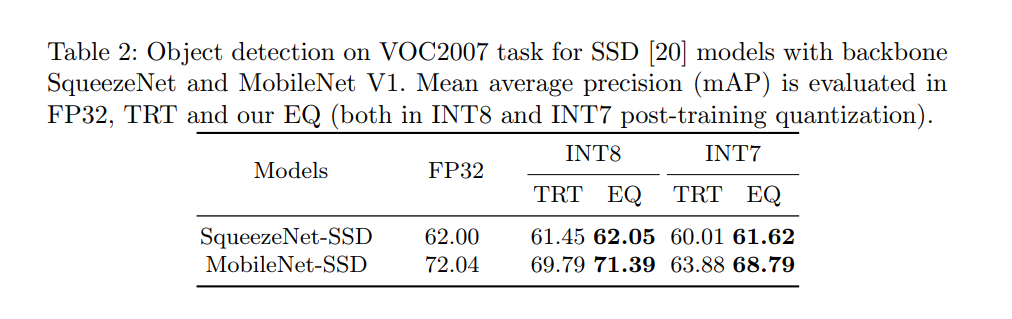

深度学习模型的量化有两种,在线训练和离线训练,前者时间长,后者掉精度,文章提出了一种scale optimization的离线量化方式,即EasyQuant,以卷积输出为目标,来scale权重和激活,然后用INT7量化,推理时中间用INT16,和整型Winograd卷积加速推理,据论文所述,此量化方法超过TensorRT的INT8量化精度。

量化过程包含scaled,round和clipped三个阶段,X是实数域,Q是b bits整数域。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢