介绍一篇来自浙江大学侯廷军教授课题组、武汉大学陈曦教授课题组、中南大学曹东升教授课题组和腾讯量子实验室联合发表的一篇文章。该文章提出了多约束分子生成新方法MCMG,通过结合知识蒸馏(Knowledge Distillation)、条件 Transformer(c-Transformer)和强化学习(RL)来生成满足多个约束的分子。

论文链接:https://www.nature.com/articles/s42256-021-00403-1?proof=tr

论文链接:https://www.nature.com/articles/s42256-021-00403-1?proof=tr

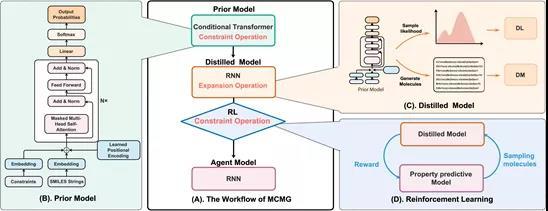

本研究的目标是通过预处理生成模型而不影响其在多约束任务中输出多样性的同时,提高分子生成模型输出所需分子的效率。为此,作者提出了一种新的分子生成方法,即多约束分子生成方法MCMG。首先,使用c-Transformer来构建生成模型;然后,采用知识蒸馏模型来降低模型的复杂度,并提升生成分子的多样性;最后,通过RL对其进行微调。蒸馏模型最初是为了将从大型模型或多个模型的集合中学到的知识转移到另一个轻量级模型以实现快速部署,但在本研究中该方法还可以大大提高生成分子的结构多样性。实验证明,MCMG方法可以高效地遍历复杂的化学空间以寻找满足多种性质约束的新型化合物。

MCMG模型的工作流程下图所示。首先训练一个c-Transformer,然后将该c- Transformer蒸馏为RNN,以便于后续与RL的应用。蒸馏后的RNN不仅可以减轻RL时的训练负担,还可以提升生成分子的结构多样性。

MCMG方法的工作流程图

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢