【2021.10】CINS: Comprehensive Instruction for Few-shot Learning in Task-oriented Dialog Systems

- 这篇做的是few-shot设定下的:intent classification;slot value prediction;NLG(就是把对话slot+intent的semantic representation变成一句流畅的自然语言)。不过这个设置和以前few-shot intent classification不太一样。首先,这里没有涉及到class transfer,训练和测试的domain都是一致的;其次这里的few-shot指的训练语料是few-shot,并不是以前的target domain是语料是少的;最后,这里的class还是比较有限的,好像不超过20类。

- 这篇主要argue的点在于现在的prompt都比较简洁,没法充分利用PLM中的知识。这里就是把扩展了prompt,然后在三个任务上验证,模型也选的比较小的T5-base,采用的策略也是prompt + LM tuning。

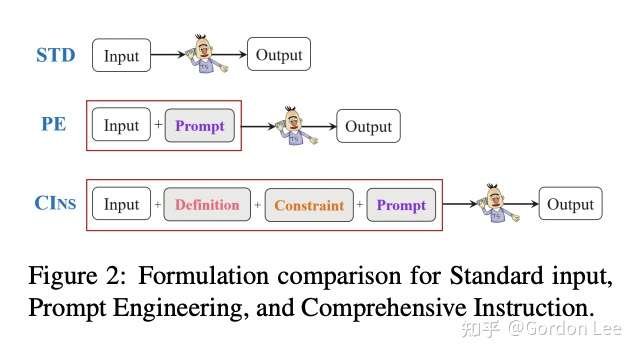

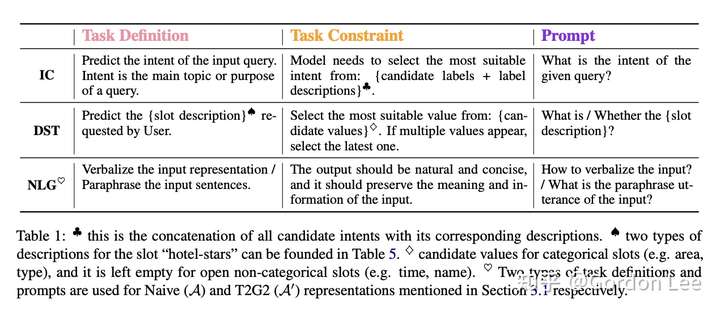

- 做法就是:设计更丰富的prompt:【input】【task definition】【constraint】【prompt】,其中task definition就是去定义task。constraint就是提供一些任务约束,比如说意图分类,其实就是提供label name和label的description,最后prompt就是query。看图就知道了。

- 一些有用的发现:这种提供更多限定和描述的prompt效果比传统的更好;对于prompt,在t5-base下,问句比陈述句更好,比如说:what is the intent of the query?好于 the intent of the query is ...;

【2021.10】ConQX: Semantic Expansion of Spoken Queries for Intent Detection based on Conditioned Text Generation

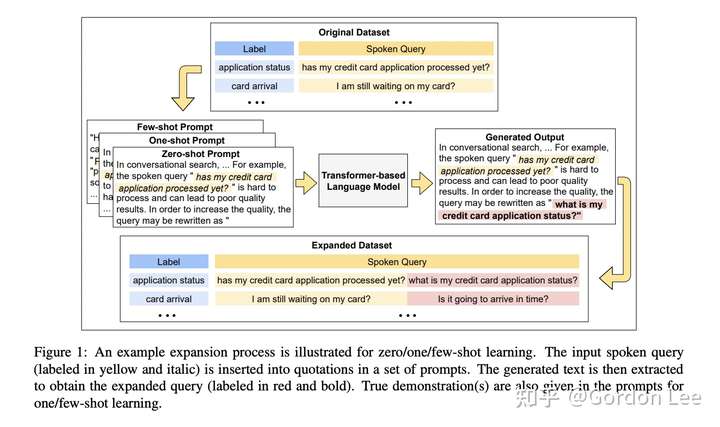

- 这篇很有意思,虽然做的是intent detection,但实际并不是去为intent detection这个任务去设计prompt。这篇的动机就是意图查询都比较口语化,表达不清晰,有很多噪音,比如歧义现象,所以query除了原始的句子以外,可以再拼接一个更加清晰的query(作者叫做Semantic Expansion),这个query就是用预训练生成模型来生成的,本质就是数据增强。

- prompt体现在用预训练生成模型+prompt去生成当前query的paraphrasing sentence,有zero-shot,few-shot,one-shot这几种,按照GPT那种,把样本拼成demonstration。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢