1、【KDD-2021】Learning How to Propagate Messages in Graph Neural Networks

链接:https://dl.acm.org/doi/10.1145/3447548.3467451

作者:Teng Xiao, Zhengyu Chen, Donglin Wang, and Suhang Wang 西湖大学、浙江大学

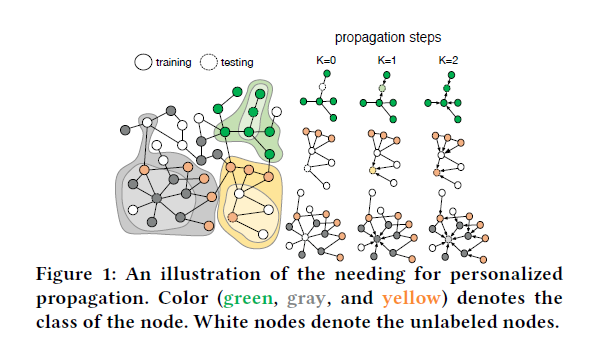

文章导读:本文认为不同的节点和不同类型的图可能需要不同的传播层数来准确预测节点标签。本文引入最优传播层数作为隐变量,以帮助找到GNN参数的最大似然估计,并通过VEM推断每个节点的最优传播层数。通过实验发现,相似类型的图一般有相似的传播策略;具有较少同类邻居的节点,需要更多的传播层数。

2、【ICLR 2018 】

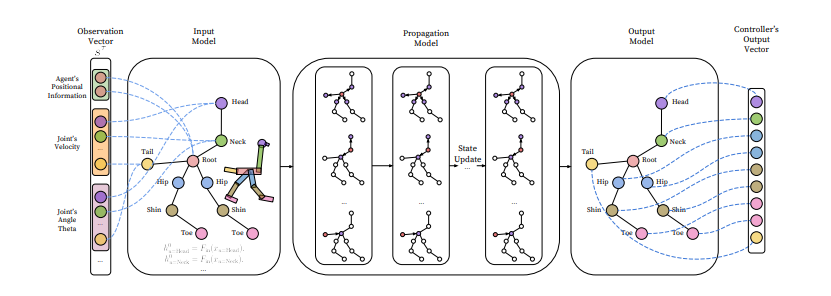

Author:Tingwu Wang, Renjie Liao, Jimmy Ba, Sanja Fidler

简介:本文解决了学习结构化策略以进行持续控制的问题。在传统的强化学习中,代理的策略由 MLP 学习,MLP 将环境中所有观察结果的串联作为预测动作的输入。在这项工作中,建议 NerveNet 对代理的结构进行显式建模,该结构自然采用图的形式。具体来说,作为代理的策略网络,NerveNet 首先在代理的结构上传播信息,然后预测代理不同部分的动作。在实验中,文章首先表明作者的 NerveNet 可与标准 MuJoCo 环境中的最新方法相媲美。进一步提出了定制的强化学习环境,用于对两种类型的结构迁移学习任务进行基准测试,即规模和残疾迁移。证明了 NerveNet 学习的策略明显优于其他模型学习的策略,并且即使在零样本设置中也能够进行迁移。

链接:https://openreview.net/pdf?id=S1sqHMZCb

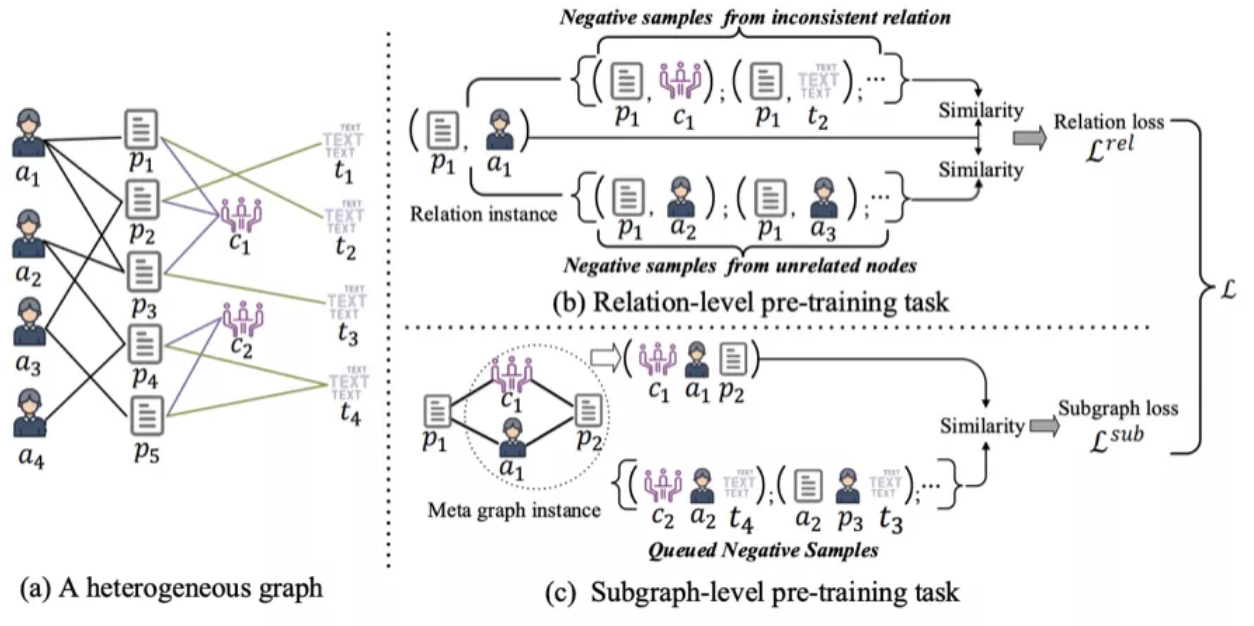

3、论文标题:Contrastive Pre-Training of GNNs on Heterogeneous Graphs

作者:Xunqiang Jiang,Beijing University of Posts and Telecommunications

文章导读:文章为异构图神经网络模型设计了新的对比学习预训练方案,提出了一种新颖的对比GNN 在异构图 (CPTHG) 上的预训练策略,通过自监督的方式捕获语义和结构属性 。具体来说,文章设计了语义感知关系级和子图级的预训练任务。文章在三个真实世界数据集上进行了广泛的实验,证明了文章提出的的 CPT-HG 模型成功的将知识转移到各种下游任务中。

论文链接:https://yuanfulu.github.io/publication/CIKM-CPT.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢