论文链接:https://arxiv.org/abs/2106.07631

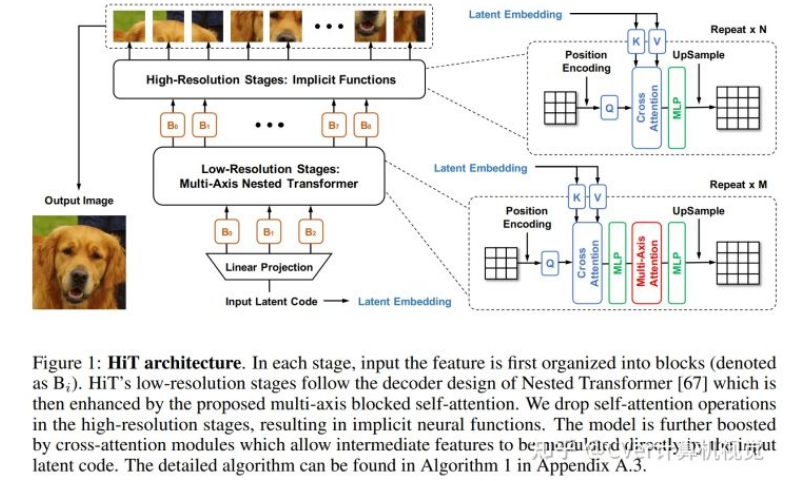

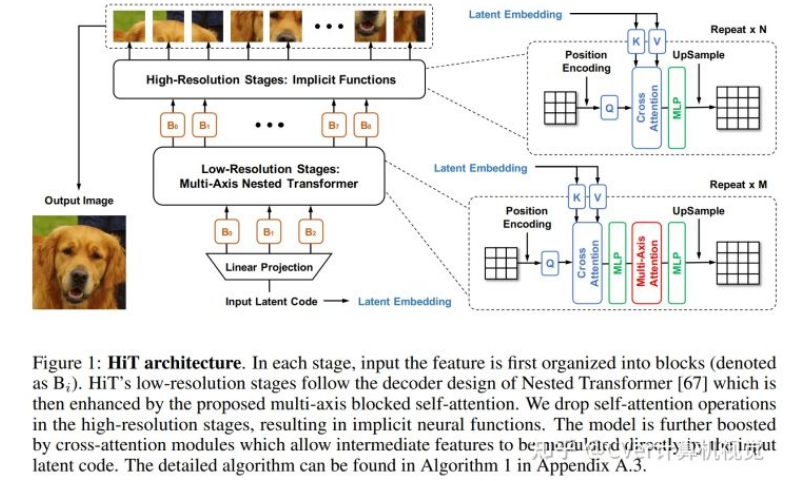

以 Transformer 为代表的基于注意力的模型可以有效地对长距离依赖进行建模,但受到自注意力操作的二次复杂性的影响,这使得它们难以用于基于生成对抗网络 (GAN) 的高分辨率图像生成。在本文中,我们介绍了 Transformer 的两个关键要素来应对这一挑战。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

论文链接:https://arxiv.org/abs/2106.07631

以 Transformer 为代表的基于注意力的模型可以有效地对长距离依赖进行建模,但受到自注意力操作的二次复杂性的影响,这使得它们难以用于基于生成对抗网络 (GAN) 的高分辨率图像生成。在本文中,我们介绍了 Transformer 的两个关键要素来应对这一挑战。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

沙发等你来抢

评论

沙发等你来抢