在 ISMAR 2021 上,商汤研究院和浙江大学 CAD&CG 国家重点实验室合作提出适应于挑战性场景下的视觉惯性里程计。本工作首先基于深度学习设计了一个鲁棒的不依赖视觉的惯性运动跟踪网络,接着紧耦合视觉、IMU 和网络信息,提出了 RNIN-VIO 系统,在安卓手机上实现了整套方案。离线数据集和在线 AR Demo 实验表明该系统的精度和鲁棒性都优于现有方法。

论文名称:RNIN-VIO: Robust Neural Inertial Navigation Aided Visual-Inertial Odometry in Challenging Scenes

论文链接

论文主页

动机:实时的高精度和鲁棒的 6DoF 运动跟踪是增强现实运用的关键技术之一。虽然现有的视觉惯性里程计只使用移动平台上消费级的相机和低廉的 IMU 就能取得比较高的运动跟踪精度和较优的鲁棒性,但是现有视觉惯性里程计仍然依赖连续可靠的视觉跟踪,在挑战性场景(如弱纹理、重复纹理、动态环境、快速运动、远景等)下很容易失效。

创新点:

1) 提出一个新的基于深度学习的惯性网络去学习人体运动规律;设计了相对和绝对损失,能让网络同时关注到局部精度和全局精度

2) 提出了紧耦合视觉、IMU、惯性网络测量的多传感器融合里程计

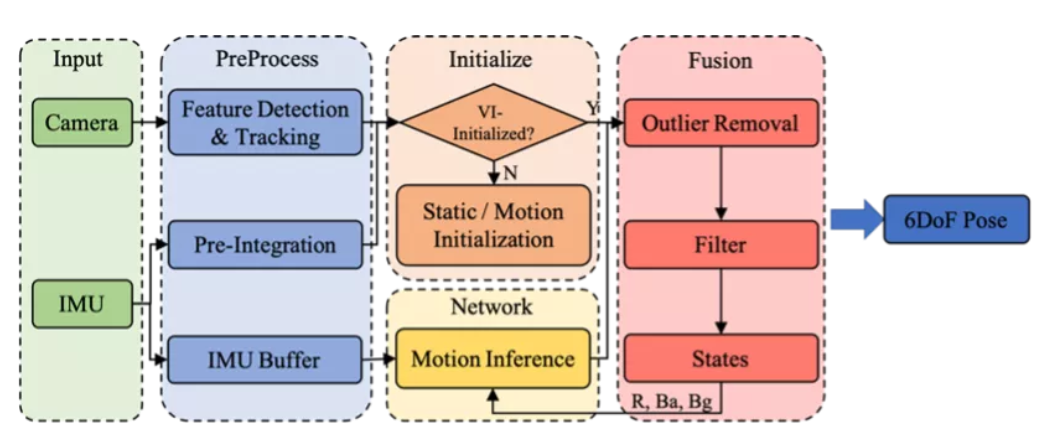

图1 系统框架

如图1所示,系统主要包括四部分。预处理,初始化,惯性神经网络和融合滤波。

预处理:从每帧图像上提取角点特征,并利用 KLT 进行连续帧图像跟踪。连续两帧图像之间的 IMU 进行预积分处理。同时我们维护一个 IMU Buffer 作为惯性神经网络的输入数据。

初始化:为了让系统适应各种各样的运动,当系统检测到当前是静止时,采用静止初始化,若为运动,则采用运动初始化。

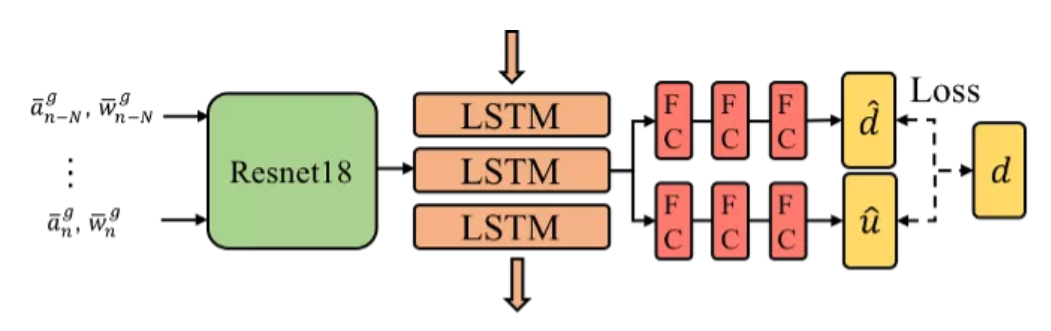

惯性神经网络:惯性神经网络学习运动的先验分布。网络采用一个局部窗口的 IMU 作为输入,在无需已知初始速度情况下,回归窗口的相对位移和不确定度。不考虑噪声情况下,同样的窗口 IMU 数据,不同初速度对应不同的运动,所以单纯靠 IMU 数据是无法估计具体运动的。我们相信尽管运动分布是非常广阔的,但是人体运动分布应该是非常窄的,同样的 IMU 数据对应不同的运动应该非常罕见。基于这个考虑,我们相信网络可以进行合理的运动预测。

融合滤波:滤波系统紧耦合视觉、IMU 和网络测量信息。其中视觉信息是可以被随时移除的,这样系统将变成纯 IMU 里程计。

图2 惯性神经网络

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢