Google在ICCV 2021上发表了一篇文章,提出了一种自监督的方法,使用了一个大型、未标记的人类活动数据集。所建立的模型具有高度的抽象性,可以任意时间间隔对未来进行远距离预测,并能够根据上下文选择对未来的远期预测。

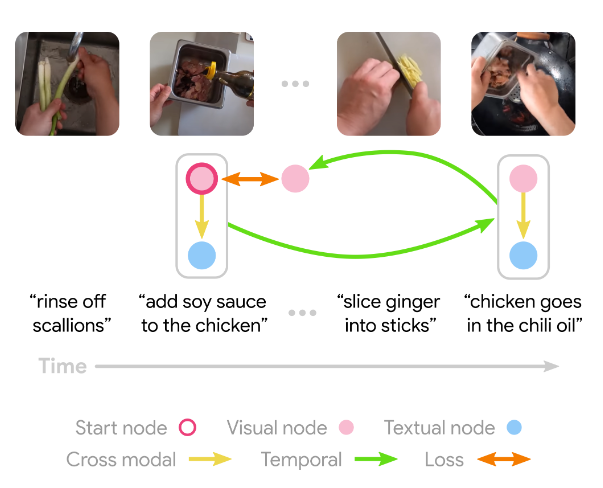

模型具有多模态周期一致性(Multi-Modal Cycle Consistency,MMCC)的目标函数,能够利用叙事教学视频来学习一个强大的未来预测模型。研究人员在文中还展示了如何在不进行微调的情况下,将MMCC应用于各种具有挑战性的任务,并对其预测进行了量化测试实验。

模型具有多模态周期一致性(Multi-Modal Cycle Consistency,MMCC)的目标函数,能够利用叙事教学视频来学习一个强大的未来预测模型。研究人员在文中还展示了如何在不进行微调的情况下,将MMCC应用于各种具有挑战性的任务,并对其预测进行了量化测试实验。

研究中主要解决了未来预测的三个核心问题:

1. 手动标注视频中的时间关系是非常耗时耗力的,而且很难定义标签的正确性。所以模型应当能够从大量未标记的数据中自主学习和发现事件的变换,从而实现实际应用。

2. 对现实世界中复杂的长期事件变换进行编码需要学习更高层次的概念,这些概念通常在抽象的潜在表示中可以找到,而非只是图像中的像素。

3. 时序的事件变换非常依赖于上下文,所以模型必须能够在可变时间间隔下预测未来。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢