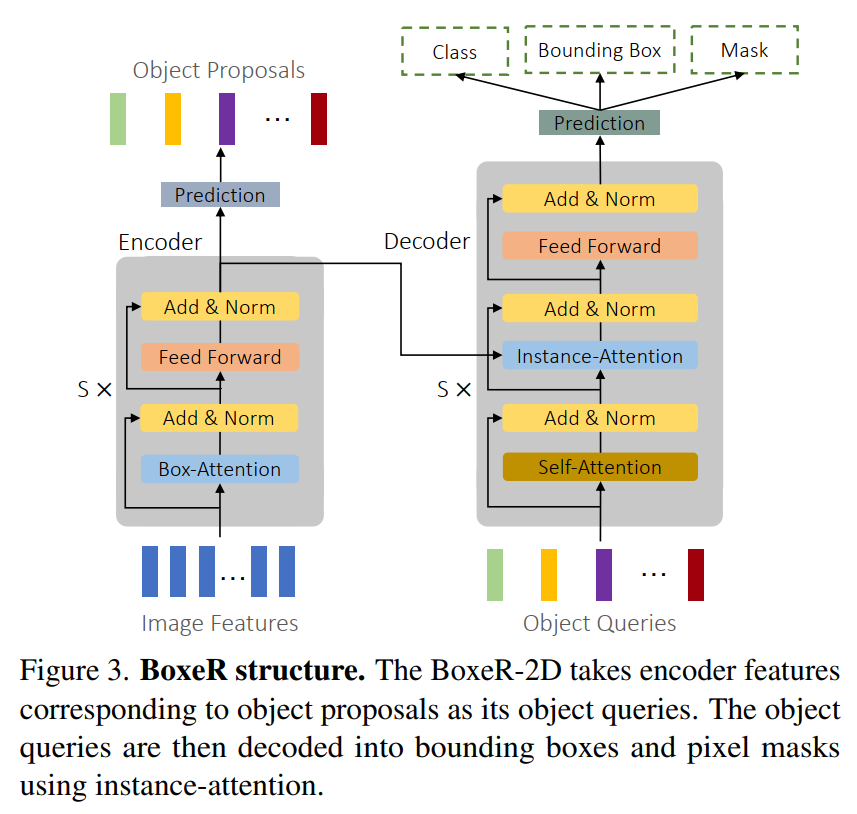

在本文中提出了一种简单的注意力机制Box-Attention。它支持网格特征之间的空间交互(从感兴趣的Box中采样),并提高了Transformer针对多个视觉任务的学习能力。

具体来说,介绍的BoxeR,即Box Transformer的缩写,它通过预测输入特征图上的参考窗口的转换来处理一组Box。BoxeR通过考虑它的网格结构来计算这些Box上的注意力权重。值得注意的是,BoxeR-2D在其注意力模块中自然地对Box信息进行推理,使其适合于端到端实例检测和分割任务。通过学习box-attention模块中的旋转不变性,BoxeR-3D能够从鸟瞰平面生成判别信息,用于三维端到端目标检测。

实验表明,提出的BoxeR-2D在COCO检测上取得了更好的结果,在COCO实例分割上达到了与完善且高度优化的Mask R-CNN相当的性能。BoxeR-3D在没有任何特定类别的优化的情况下,已经在Waymo Open的车辆类别中获得不错的结果。

论文链接:

https://arxiv.org/abs/2111.13087

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢