标题:德克萨斯大学、加利福尼亚大学|FuseDream: Training-Free Text-to-Image Generation with Improved CLIP+GAN Space Optimization(FuseDream:无需训练的文本到图像生成具有改进的 CLIP+GAN 空间优化)

作者:Xingchao Liu, Chengyue Gong, Qiang Liu等

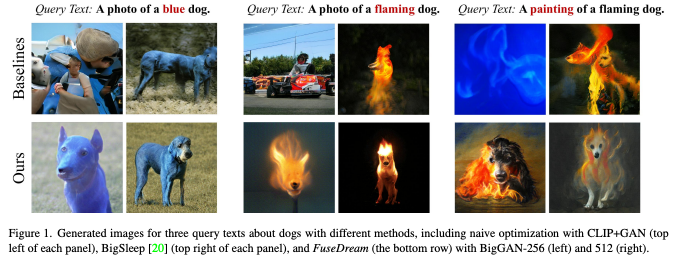

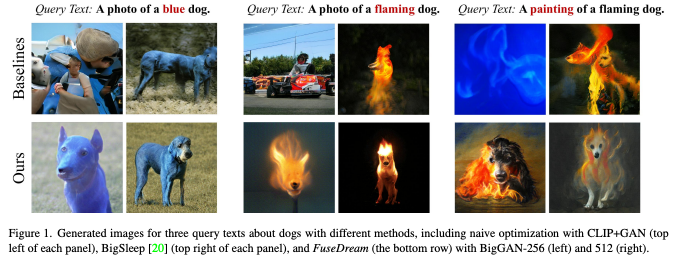

简介:本文介绍了一种自然语言生成图像算法。作者使用CLIP+GAN方法处理文本到图像的生成,其中在现成的GAN的潜在空间中进行优化,使用CLIP模型测量的给定输入文本,以找到达到最大语义相关性分数的图像。与从头开始训练从文本到图像映射的生成模型的传统方法相比,CLIP+GAN方法是免训练的、零样本的,并且可以使用不同的生成器轻松定制。然而,在GAN 空间中优化CLIP分数会产生一个极具挑战性的优化问题,以及现成的Adam等优化器未能产生令人满意的结果。当被不同的输入文本提示时,FuseDream可以生成没有出现在GAN的训练数据,具有不同对象、背景、艺术风格和新颖反事实概念的高质量图像。从数量上讲,FuseDream生成的图像在MS COCO数据集,无需额外架构设计或训练。

代码下载:https://github.com/gnobitab/FuseDream

论文下载:https://arxiv.org/pdf/2112.01573v1.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢