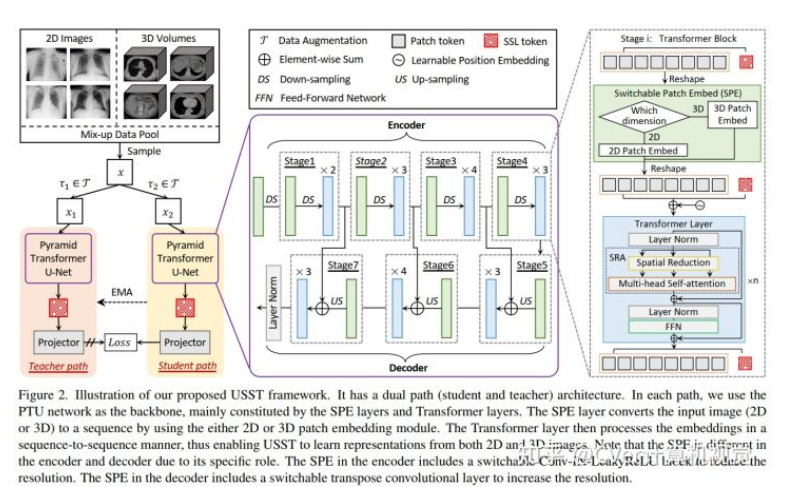

本文提出了通用自监督Transformer (USST) 框架,来打破2D和3D医学图像中预训练之间的障碍,性能更加有效且通用,在六个2D/3D医学图像分类和分割任务上表现良好。

单位:阿德莱德大学, 西北工业大学

论文:https://arxiv.org/abs/2112.0935

自监督学习 (SSL) 为更好地利用未标记数据开辟了巨大的机会。它对于以缺乏注释而闻名的医学图像分析至关重要。但是,当我们尝试在 SSL 中使用尽可能多的未标记医学图像时,必须打破维度障碍(即可以同时使用 2D 和 3D 图像)。

在本文中,我们提出了一种基于学生-教师范式的通用自监督Transformer (USST) 框架,旨在利用大量未标记的多维度医学数据来学习丰富的表示。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢