近年来,深度神经网络被广泛应用于计算机视觉、自然语言处理和语音识别等领域。然而研究表明,深度神经网络很容易受到来自输入的细微干扰的攻击,从而导致模型预测出不正确的输出,这也引起了研究人员对深度神经网络的安全隐患的关注。对抗样本检测作为抵御对抗攻击的手段之一,也得到了研究人员的广泛研究。

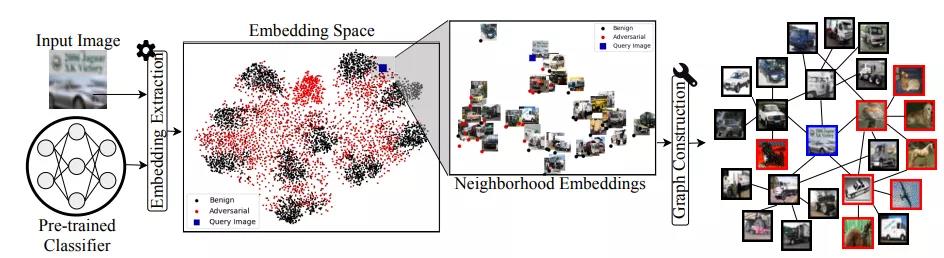

相比于对抗训练,对抗样本有无需重训练模型,且可以适配到已经部署的模型上的优势。先前的对抗样本检测研究表明输入样本和它的邻居在特征空间中表现出显著的一致性,基于此,本文提出了Latent Neighborhood Graph来表征输入的邻居。与先前的工作DkNN[1]相比,本文所提的LNG有以下三方面优势:

-

LNG 覆盖了多跳邻居,它表征了输入样本的局部流形,而 DkNN 仅描述了输入样本的流形

-

LNG基于在嵌入空间中学习到的连通性自适应地聚合邻域信息,这比 DkNN中单纯使用类标签获得了更丰富的信息

-

LNG在检测中包含了对抗邻居和良性邻居,而 DkNN 仅利用了良性邻居

论文链接:

贡献:

-

本文将对抗样本检测的问题转化为了一个图分类问题,作者通过使用参考样本有效地构建了一个Latent Neighborhood Graph,用于对抗样本检测

-

所提方法根据邻居样本的距离动态估计潜在邻域图的邻接矩阵,并自适应地聚合来自良性和对抗邻居的信息以进行对抗样本检测

-

使用已知和未知的对抗样本生成方法生成的对抗样本,在灰盒和白盒检测达到sota性能

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢