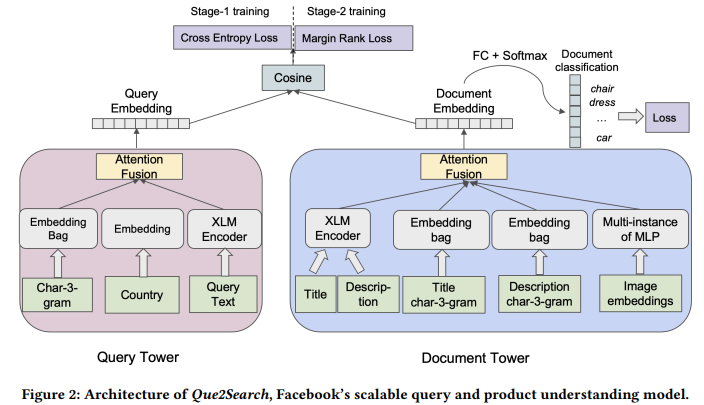

本篇文章介绍了query和商品的语义理解系统Que2Search。之前的商品向量检索大多只使用n-gram的稀疏特征做embedding,没有使用BERT类模型,所以对自然语言的理解能力不够好。但是,如果使用Transformer类模型,时间复杂度较高,对搜索的时延要求也更加严苛。

本论文提出的模型在性能上实现了CPU上的实时推理99线小于1.5ms;在效果上,离线相关性指标提升5%,线上参与度指标提升4%。能够有如此提升的原因大致是:

- 在双塔上引入了用document预测query的多任务学习,强迫模型理解query意图;

- 采用两阶段训练范式,第一阶段用in-batch负样本,第二阶段用难负例进行课程学习;

- 使用了包括多模态在内的多种特征,并且用注意力机制融合这些特征。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢