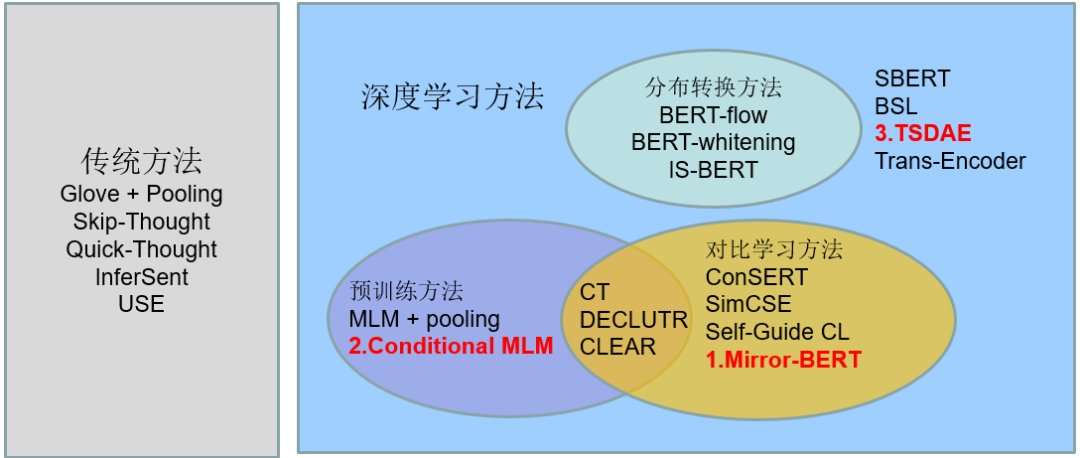

本文根据句子表示学习方法各自的特点,将近期方法按以下方式划分,并选择各类别下具有代表性的工作展开介绍。

图1 近期句子表示学习方法划分。

-

Fast, Effective, and Self-Supervised: Transforming Masked Language Models into Universal Lexical and Sentence Encoders

-

Universal Sentence Representation Learning with Conditional Masked Language Model

-

TSDAE: Using Transformer-based Sequential Denoising Auto-Encoder for Unsupervised Sentence Embedding

通过对近期句子表示学习方法的学习,从这些方法中发现了一些共有的结论:

-

在已有预训练模型上,进行合理的无监督微调,能够将模型在预训练过程中得到的知识运用于对句子的表示,微调后甚至超过有监督方法(SBERT)在其他通用领域监督训练的效果。

-

预训练阶段模型如果能够强化对句子编码的偏置,能够有效提升下游任务中的句子表示效果。这一点取决于合理的模型结构以及训练任务设置,并且训练任务适用于预训练以及预训练后的微调。

-

NLP中对比学习或其他无监督方法,大部分依赖于数据增强,相似正例的构造,目前没有发现同义词替换效果(CLEAR中验证)高于简单的删除、打乱和dropout,并且回译方法还无人实验,初步推测过于大幅度的破坏原句会引入过多噪声,增加任务难度导致模型效果下降。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢