作者:Rong Liang, Yujie Lu, Zhen Huang, 等

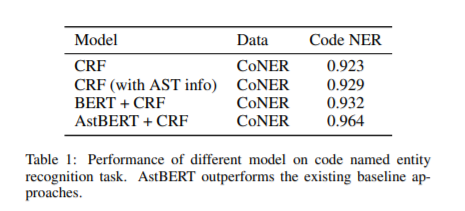

简介:本文主要研究以抽象语法树提升源码理解领域的预训练模型性能。使用预训练的语言模型(如BERT)来理解源代码在自然语言处理社区中引起了越来越多的关注。然而,在应用这些语言模型直接解决与编程语言相关的问题时存在一些挑战,其中一个重要的挑战是缺乏领域知识问题,这大大降低了模型的性能。为此,作者提出了 AstBERT 模型:一种预训练的语言模型,旨在使用抽象语法树 (AST) 更好地理解 编程语言。具体来说,作者从 GitHub 收集大量源代码(Java 和 python),并通过代码解析器将上下文代码知识整合到作者的模型中,其中可以解释和集成源代码的 AST 信息。作者分别验证了所提出的模型在代码信息提取和代码搜索任务上的性能。实验结果表明: AstBERT 模型在两个下游任务上都达到了最先进的性能(代码信息提取任务为 96.4%,代码搜索任务为 57.12%)。

论文下载:https://arxiv.org/pdf/2201.07984.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢