论文标题:GNN-LM: Language Modeling based on Global Contexts via GNN

作者:Yuxian Meng, Shi Zong, Xiaoya Li, Xiaofei Sun, Tianwei Zhang, Fei Wu, Jiwei Li

论文链接:https://arxiv.org/abs/2110.08743

接收会议:ICLR 2022

代码链接:https://github.com/ShannonAI/GNN-LM

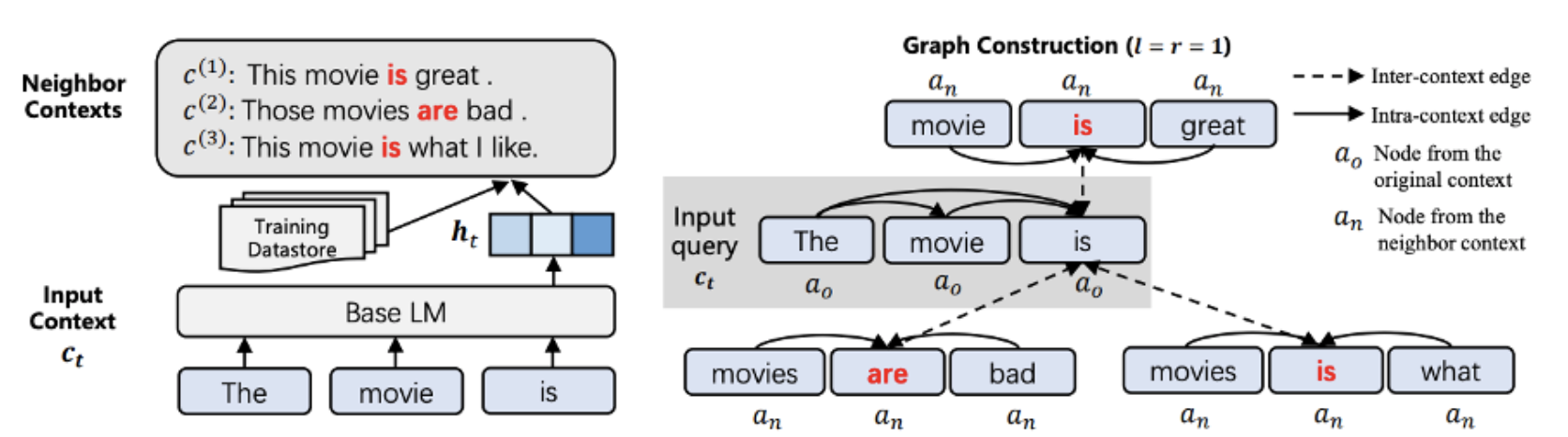

本文提出了一个全新的语义理解模式,将闭卷考试转化为开卷考试的语义理解模式:在测试的时候,模型允许参考训练数据。这样就将之前的“背”,转变成了“抄”,模型可以直接使用训练集中相关的例子来协助决策,这样问题的难度就大大降低了。以语言模型来举例,例如,给定前文“J.K.罗琳最知名的作品是”来预测后面的词“哈利波特”,如果语言模型可以引用训练集中相关的上下文“J.K.罗琳撰写了哈利波特系列书籍”,那么它就会更容易将下一个token预测为“哈利”,就像是有参考书的开卷考试比闭卷考试要更简单一样。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢