论文标题:

Dual Contrastive Learning: Text Classification via Label-Aware Data Augmentation

论文链接:

https://arxiv.org/pdf/1905.09788.pdf

代码链接:

https://github.com/hiyouga/dual-contrastive-learning

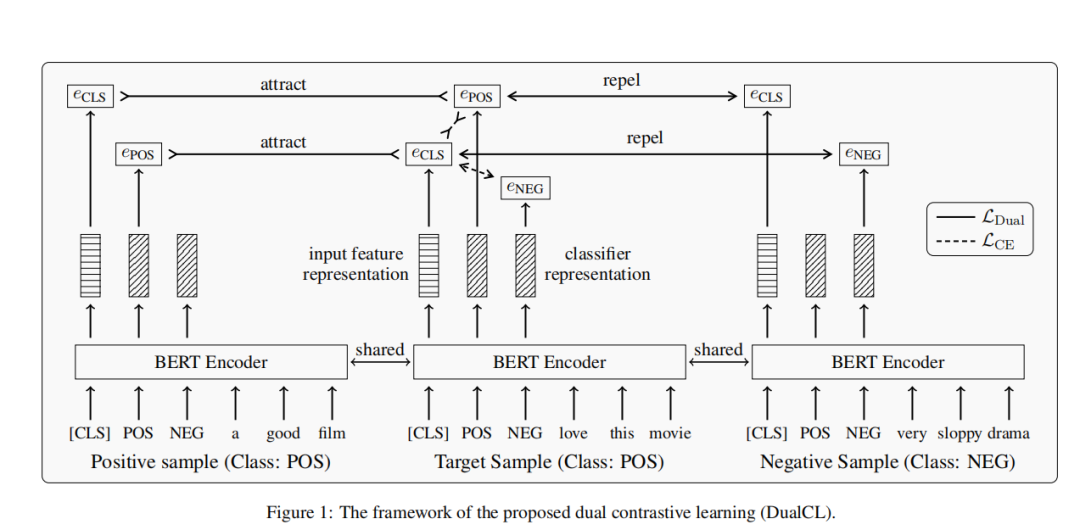

对比学习在无监督环境下通过自我监督进行表征学习方面取得了显著的成功。然而,有效地使对比学习适应于监督学习任务在实践中仍然是一个挑战。在这项工作中,作者提出了一个对偶对比学习(DualCL)框架,在同一空间内同时学习输入样本的特征和分类器的参数。具体来说,DualCL将分类器的参数视为关联到不同标签的增强样本,然后利用其进行输入样本和增强样本之间的对比学习。对5个基准文本分类数据集及对应低资源版本数据集的实验研究表明,DualCL分类精度明显得到提高,并证实了DualCL能够实现样本判别表示的效果。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢