这篇论文展示了信息检索可以用一个Transformer来完成,其中,关于语料库的所有信息都被编码在Transformer模型的参数中。

论文标题:

Transformer Memory as a Differentiable Search Index

链接:

https://arxiv.org/abs/2202.06991

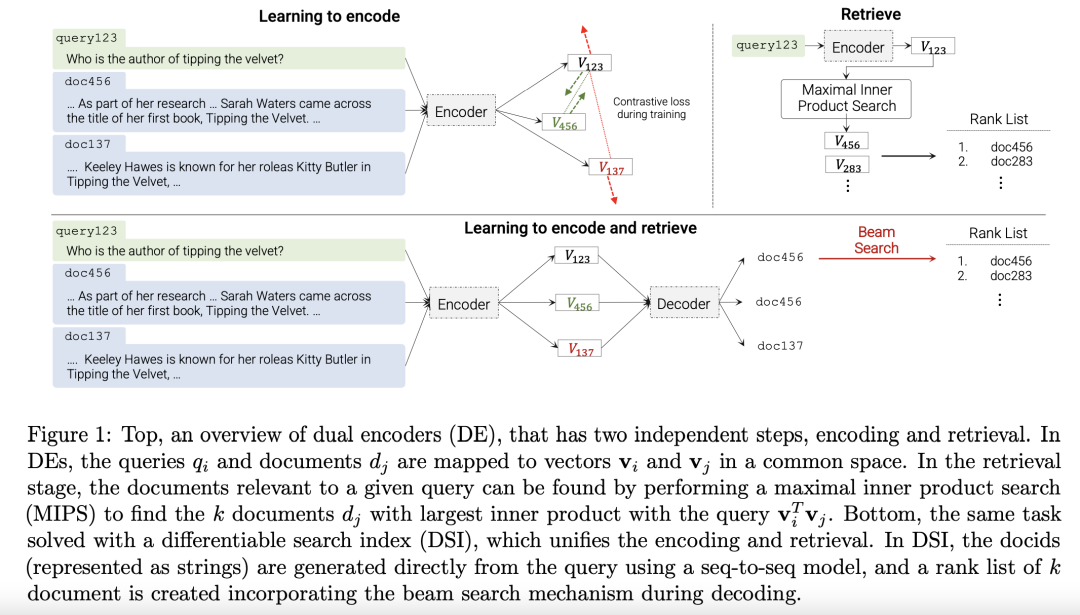

作者提出了可微搜索索引(Differentiable Search Index,DSI)的概念,这是一种新的搜索范式,它可以学习出一个Query-to-DocID的文本检索模型,将用户Query直接映射到相关的DocID节点上;换句话说,DSI模型直接使用其模型参数来回答用户查询,极大地简化了整个检索过程。

上图展示了经典的双塔模型(Dual Encoder)+最大内积检索(MIPS)的经典检索范式,与本文提出的可微搜索索引(DSI)的范式的区别。后者统一了模型的训练与检索。

实验表明,给定适当的设计选择,DSI不仅显著优于双塔模型为代表的强基线模型,此外,DSI展示了很强的泛化能力,在zero-shot实验中显著优于BM25基线。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢