【标题】TransDreamer: Reinforcement Learning with Transformer World Models

【作者团队】Chang Chen, Yi-Fu Wu, Jaesik Yoon, Sungjin Ahn

【发表日期】2022.2.19

【论文链接】https://arxiv.org/pdf/2202.09481.pdf

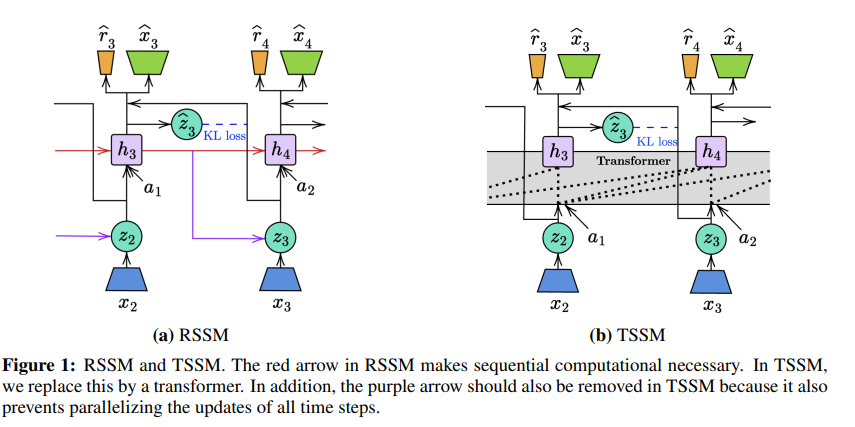

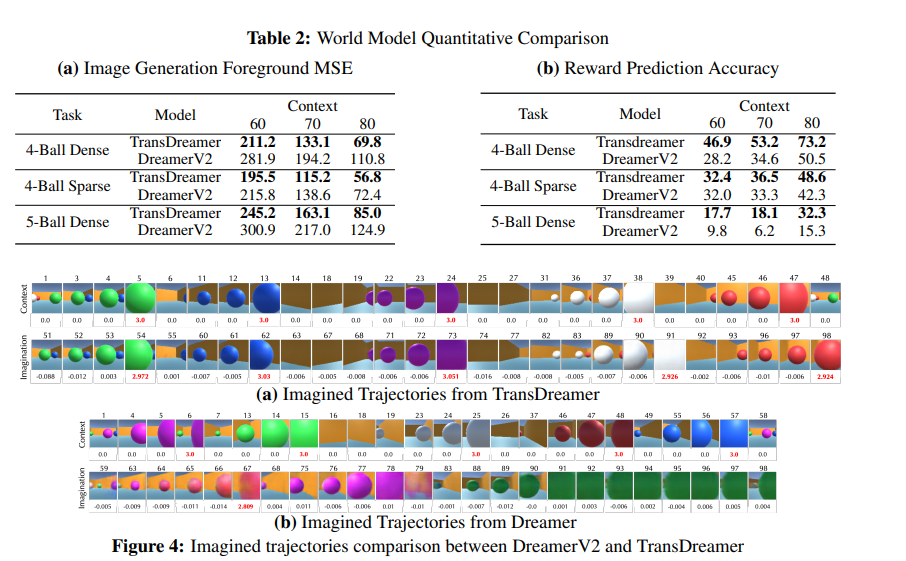

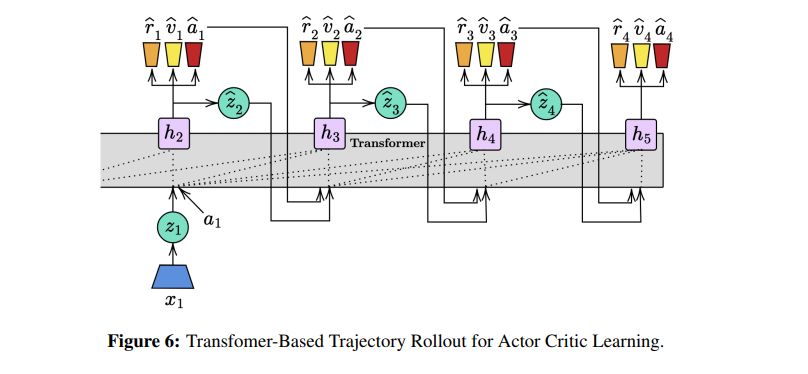

【推荐理由】Dreamer智能体提供了基于模型的强化学习(MBRL)的各种优势,例如样本效率、可重用知识和安全规划。然而,它的世界模型和政策网络继承了递归神经网络的局限性,因此MBRL框架如何从变压器的最新进展中受益成为了一个重要的问题,以及这样做面临的挑战是什么。本文提出了基于Transformer 的MBRL代理,称为TransDreamer。其首先介绍Transformer状态空间模型,这是一个利用Transformer进行动力学预测的世界模型。然后,通过与基于Transformer 的策略网络共享这个世界模型,并在训练基于变压器的RL代理时获得稳定性。在实验中,本文将所提出的模型应用于2D视觉RL和3D第一人称视觉RL任务,这两种任务都需要长距离的内存访问来进行基于内存的推理。研究结果表明,在这些复杂的任务中,该模型的性能优于Dreamer。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢