标题:北大|SGPT: GPT Sentence Embeddings for Semantic Search(SGPT:用于语义的 GPT 句子嵌入搜索)

作者:Niklas Muennighoff

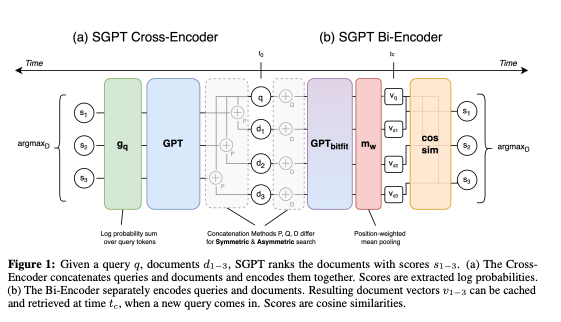

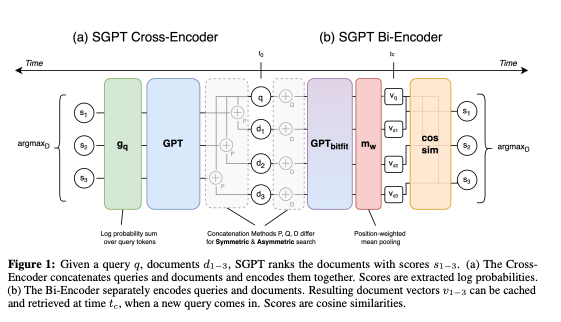

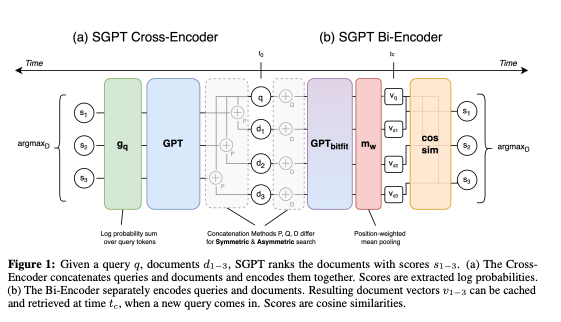

简介:本文介绍了一种用于检索的文本表示算法。GPT变换器是可用的最大语言模型,但语义搜索是以 BERT 变换器为主。作者提出了 SGPT-BE和SGPT-CE用于将GPT模型作为双编码器或交叉编码器应用于对称或非对称搜索。SGPT-BE通过对比产生语义上有意义的句子嵌入仅对偏置张量进行微调和一种新颖的池化方法。一个58亿的参数SGPT-BE比最佳可用句子嵌入的性能高出6%BEIR上最新的最新技术。它优于同时提出的OpenAI-175B Davinci端点的嵌入,可微调 250,000倍以上参数。SGPT-CE使用来自GPT模型的对数概率,无需任何微调。一种61亿参数SGPT-CE在BEIR上设置了无监督的最先进技术。它在7个数据集上击败了有监督的最先进技术,但在其他数据集上明显失败数据集。作者展示了如何通过调整提示来缓解这种情况。SGPT-BE和SGPT-CE性能随模型大小而变化,然而,增加了应考虑延迟、存储和计算成本。

代码下载:https://github.com/Muennighoff/sgpt

论文下载:https://arxiv.org/pdf/2202.08904v1.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢