2020 年是立体神经渲染(Volumetric neural rendering)爆发的一年,比如 NeRF 可以生成高质量的视图合成结果,但这种方法需要对每个场景进行优化,导致重建时间过长。另一方面,深度多视图立体(multi-view stereo)方法可以通过网络推理快速重建场景几何。

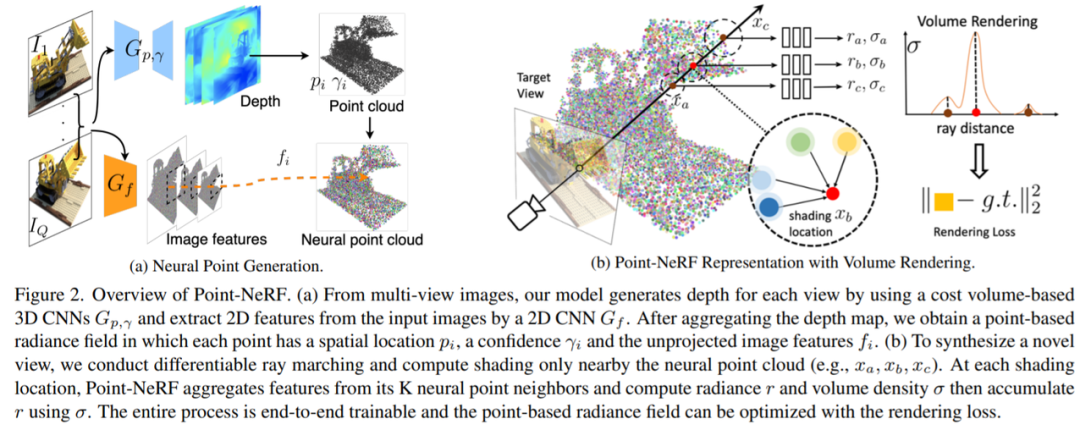

来自南加州大学、Adobe Research 的研究者们提出了 Point-NeRF,该方法使用神经 3D 点云及其相关神经特征,将立体神经渲染以及深度多视图立体方法两者的优点进行结合,来建模辐射场。

论文地址:

https://arxiv.org/pdf/2201.08845.pdf

论文主页:

https://xharlie.github.io/projects/project_sites/pointnerf/

在本文中,从 1000 个点发展出完整的点云,通过逐步优化最初的 COLMAP 点的渲染结果,在基于光线行进的渲染 pipeline 中,通过聚合场景表面附近的神经点特征,Point-NeRF 可以被有效渲染。此外,Point-NeRF 可通过对预训练深度网络的直接推理进行初始化,产生神经点云;该点云可以被微调,比 NeRF 训练时间快 30 倍,且重建视觉质量超过 NeRF。Point-NeRF 可以与其他 3D 重建方法相结合,并通过一种新的剪枝和增长机制处理这些方法中的错误和异常值。在 DTU、NeRF Synthetics、ScanNet 和 Tanks and Temples 数据集上的实验表明,Point-NeRF 可以超越现有方法,取得 SOTA 结果。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢