标题:康奈尔、谷歌|Transformer Quality in Linear Time(线性时间的变换器质量)

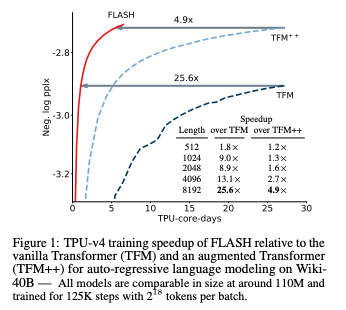

简介:本文提出了一种改进的变换器结构。作者重新审视了变换器中的设计选择,并提出解决处理长序列弱点的方法。首先,作者提出一个简单层命名为门控注意力单元,其中允许使用较弱的单头注意力,同时将质量损失降至最低。然后作者提出一种互补的线性近似方法到这个新层,它是加速器友好的和高度的质量竞争力。模型命名为FLASH(单头快速线性注意力),两个改进变换器短序列(512)和长序列(8K)上下文长度实现匹配的困惑度,实现在Wiki-40B训练速度提升高达4.9×,在自回归语言建模PG-19上提升12.1x,和屏蔽语言建模C4上的4.8×训练速度提升。

https://arxiv.org/pdf/2202.10447.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢