论文标题:

Sequential Recommendation via Stochastic Self-Attention

论文链接:

https://arxiv.53yu.com/pdf/2201.06035.pdf

代码:

https://github.com/zfan20/STOSA

序列推荐中一种常用的方式是采用类似transformer的结构,利用点积方式的自注意力机制发掘行为序列中不同商品的关系,而真实数据中,用户的行为具有不确定性,因此行为序列是具有不确定性的,直接用点积形式的自注意力机制无法很好的捕获行为中商品之间的关系。

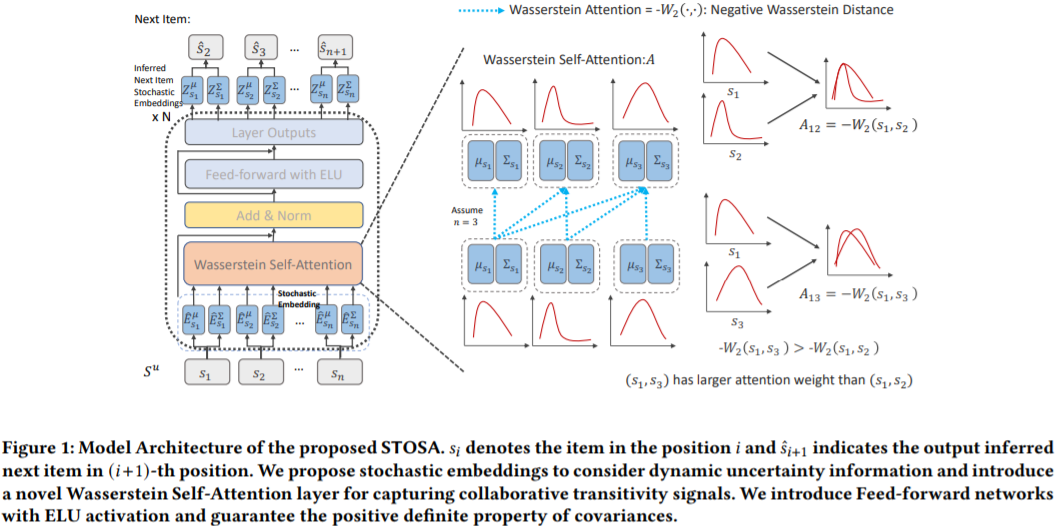

本文提出了随机自注意力机制STOSA来考虑不确定性,并且对BPR损失加入正则来约束正负样本关系。

如图 1 所示为STOSA的结构。首先将商品表示为具有椭圆高斯分布的随机embedding,包括平均embedding和协方差embedding。然后设计一个基于 Wasserstein 距离的新型 Wasserstein 自注意力模块来推断随机序列embedding。采用 Wasserstein 距离来衡量具有不确定性信号的序列中商品之间的相异性。最后,在标准 BPR 损失中加入了一个新的正则化项,用于测量正项和负项之间的距离。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢