【标题】DreamingV2: Reinforcement Learning with Discrete World Models without Reconstruction

【作者团队】Masashi Okada, Tadahiro Taniguchi

【发表日期】2022.3.1

【论文链接】https://arxiv.org/pdf/2203.00494.pdf

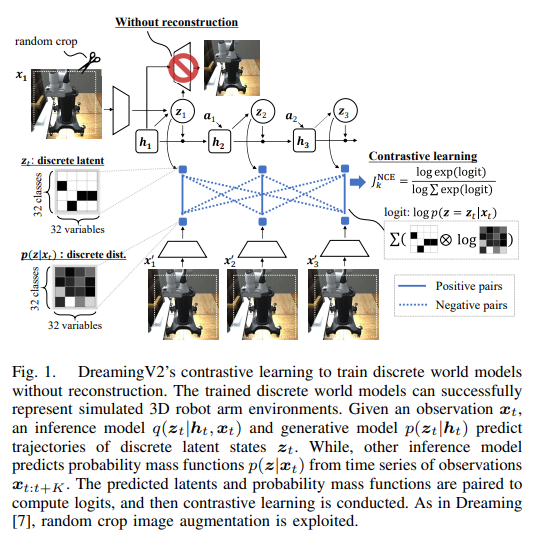

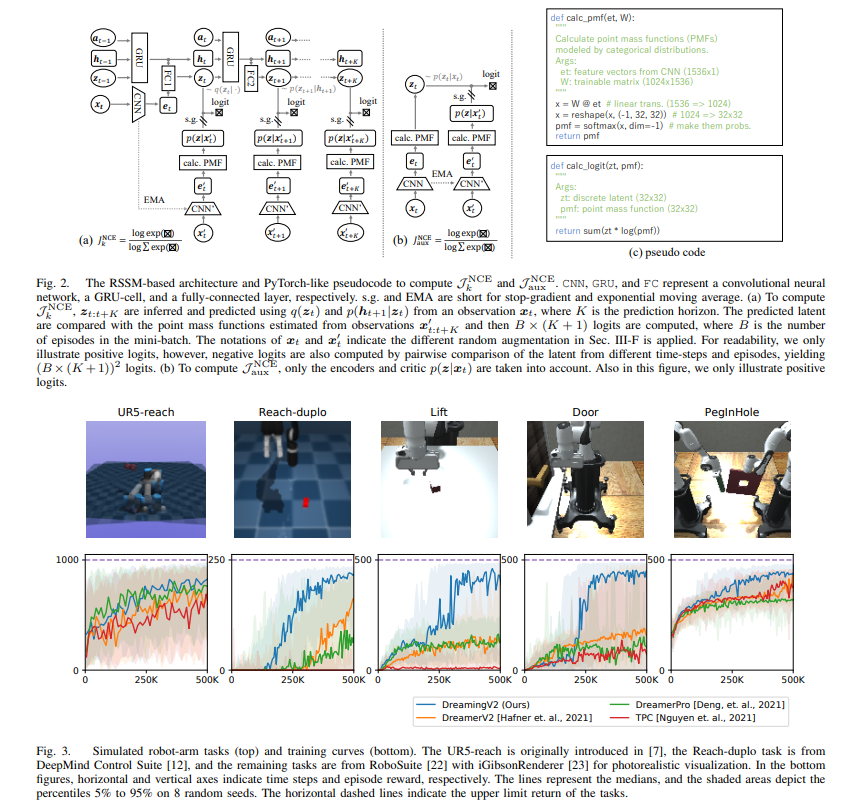

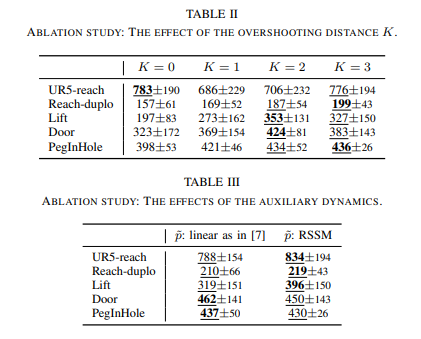

【推荐理由】本文提出了一种新的世界模型强化学习方法 DreamingV2,它是 DreamerV2 和 Dreaming 的协作扩展。DreamerV2 是一种基于像素的前沿模型强化学习技术,它使用离散世界模型来表示具有分类变量的潜在状态。Dreaming也是一种像素强化学习的形式,它试图通过涉及无重构对比学习目标来避免一般世界模型训练中的自动编码过程。所提出的DreamingV2是一种新颖的方法,它既采用DreamingV2的离散表示,又采用了DreamingV2的无重构目标。与 DreamerV2 和其他最近无重构的基于模型的方法相比,DreamingV2 在五个模拟具有挑战性的 3D 机械臂任务上取得了最好的成绩。本文相信DreamingV2将是一个可靠的机器人学习解决方案,因为它的离散表示适用于描述不连续的环境,并且无重建方式能够很好地管理复杂的视觉观察。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢