谷歌、Waymo|HyperPrompt: Prompt-based Task-Conditioning of Transformers(HyperPrompt:Transformers 的基于提示的任务调节)

作者:Yun He, Huaixiu Steven Zheng, Zhao Chen等

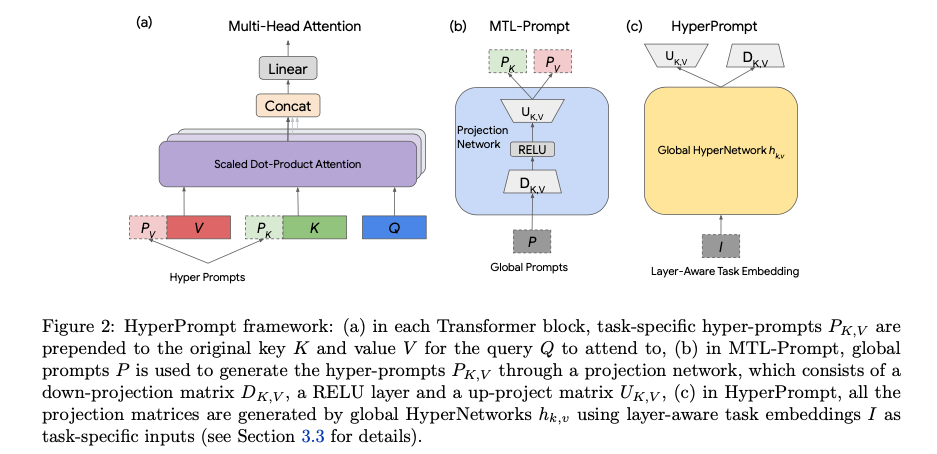

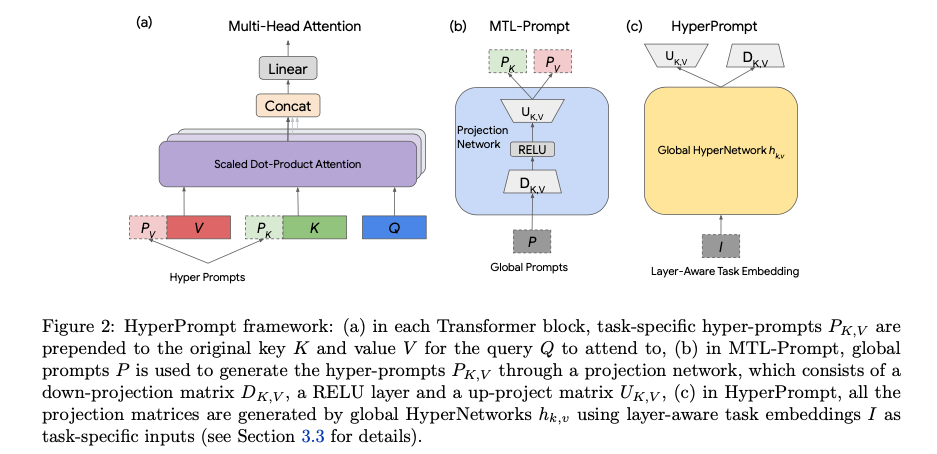

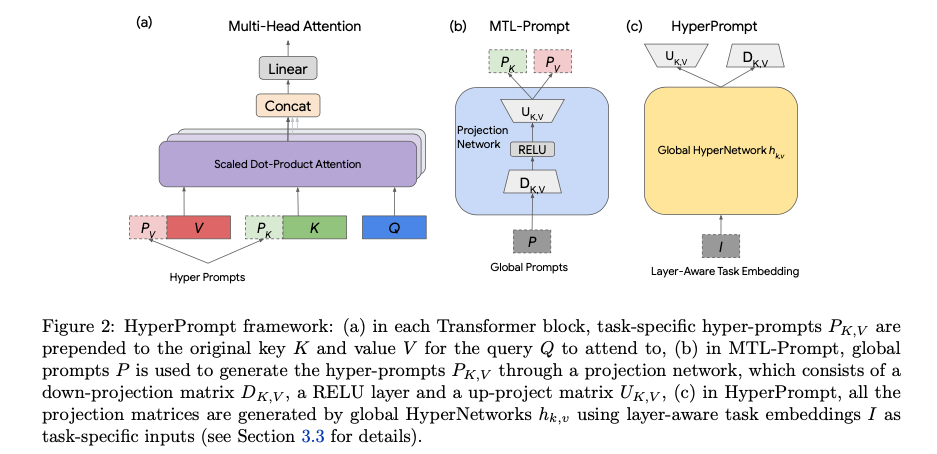

简介:本文介绍了一种提示建模方法。Prompt-Tuning是一种以参数有效的方式微调预训练语言模型的新范例。在这里,作者探索使用超网络来生成超提示:作者提出了Hyper-Prompt,这是一种新颖的架构,用于变换器中基于提示的自我注意任务调节。超级提示是通过超级网络生成的端到端可学习的。HyperPrompt允许网络学习特定于任务的特征映射,其中超级提示充当任务全局记忆,供查询参与,同时实现任务之间的灵活信息共享。作者表明,HyperPrompt与强大的多任务学习基线相比,具有低至0.14%的额外任务调节参数,实现了出色的参数和计算效率。通过广泛的实证实验,作者证明HyperPrompt可以在强大的 T5 多任务学习基线和参数高效的适配器变体(包括Prompt-Tuning和HyperFormer++对GLUE和SuperGLUE 的自然语言理解基准)上实现卓越的性能跨越许多模型尺寸。

论文下载:https://arxiv.org/pdf/2203.00759

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢