生成式统一建模,也许是信息抽取领域正在发生的一场“深刻变革”。

“All NLP Tasks Are Generation Tasks” 对于这一论断相信NLPer都不会陌生。的确,也许Seq2Seq框架提出的那一天,我们就得到这样的认知:所有的NLP任务都可以转化为生成任务。

遗憾的是:2017年至2019年间,Seq2Seq虽然在解决信息抽取问题上有过一些工作、但终究没有形成“大气候”。而过去一年来,随着生成式预训练语言模型的强大,Seq2Seq(准确地讲是Text-to-Text)“王者归来”,有了不少有趣有效的工作。

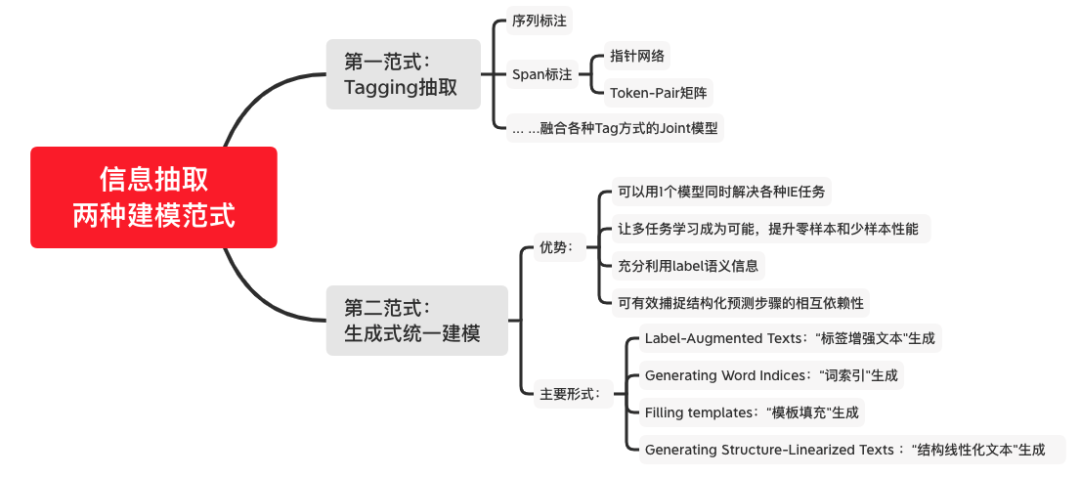

本篇文章带大家进入一个新的topic:信息抽取的「第二范式」——生成式统一建模。

本文的组织结构为:

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢