作者:Ngoc Minh Lai

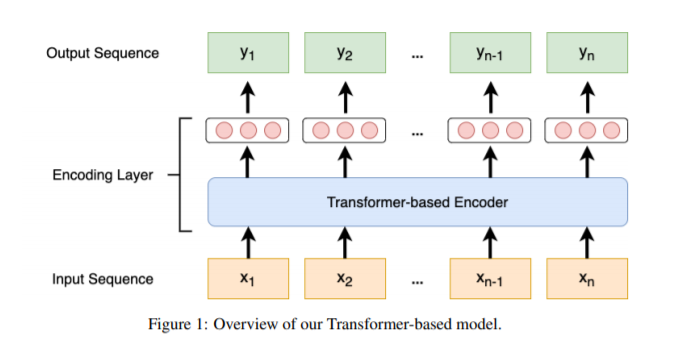

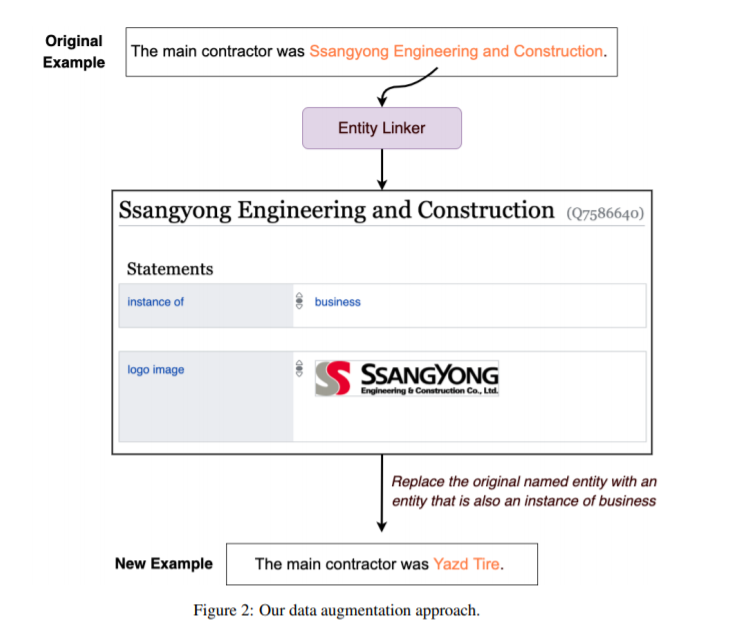

简介:本文研究运用预训练模型解决NER问题。处理复杂和模棱两可的命名实体是一个具有挑战性的研究问题,但尚未得到自然语言处理社区的足够重视。在这篇简短的论文中,作者介绍了作者参与的 2022SemEval任务 11:多语言复杂命名实体识别的英文赛道。受预训练的 Transformer 语言模型的最新进展的启发,作者为该任务提出了一个简单而有效的基于 Transformer 的基线。作者的系统在保留测试集上取得了 72.50% 的宏观 F1 分数。作者还探索了一种使用实体链接的数据增强方法。虽然该方法并没有提高最终性能,但作者也在本文中对其进行了讨论。

论文下载:https://arxiv.org/pdf/2203.03546.pdf

论文下载:https://arxiv.org/pdf/2203.03546.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢