复旦大学数据智能与社会计算实验室 (Fudan DISC) 提出了一篇对话预训练的工作,论文题目为:DialogVED: A Pre-trained Latent Variable Encoder-Decoder Model for Dialog Response Generation DialogVED,被ACL2022录取为主会长文。

论文链接:

https://openreview.net/forum?id=WuVA5LBX5zf

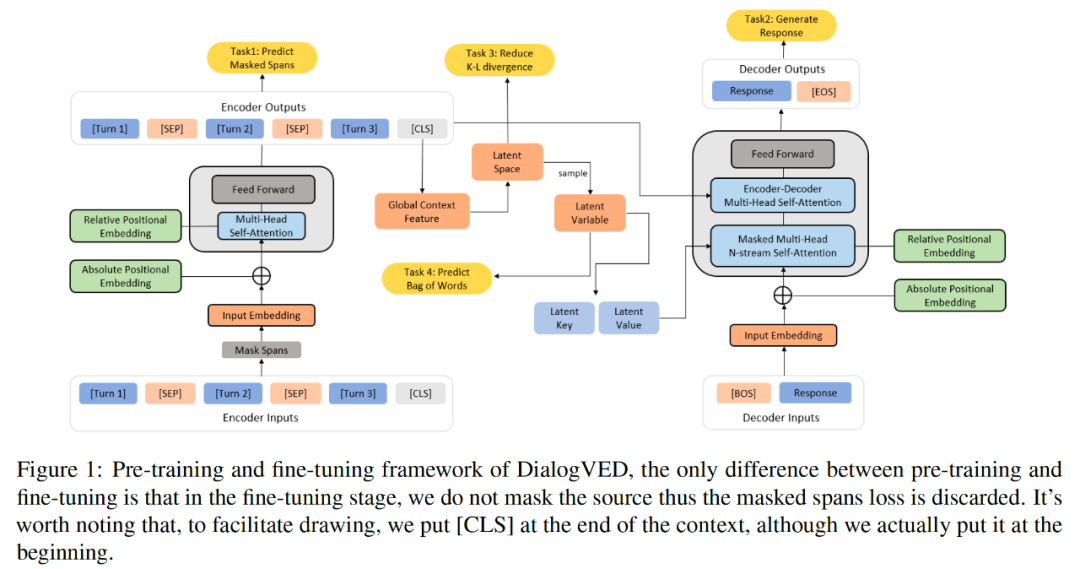

本文提出了一种新的对话预训练框架 DialogVED,它将连续隐变量引入增强的编码器-解码器框架中,以提高响应的相关性和多样性。我们使用多个任务在大型对话语料库 Reddit 上对模型进行预训练,并在 PersonaChat、DailyDialog 和 DSTC7-AVSD 基准上进行微调实验。结果表明,我们的模型在所有这些数据集上都达到了最新的水平。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢