可解释人工智能的概念最早来自于美国DARPA(美国防部高级研究计划局),2017年,为期4年的XAI研究计划启动。现在,随着 XAI 在 2021 年结束,本文总结和反思了 XAI 项目的目标、组织和研究进展。

可解释人工智能 (XAI) 的既定目标是创建一套新的或改进的机器学习技术,以产生可解释的模型,当与有效的解释技术相结合时,使最终用户能够理解、适当地信任和有效地管理新一代人工智能系统。

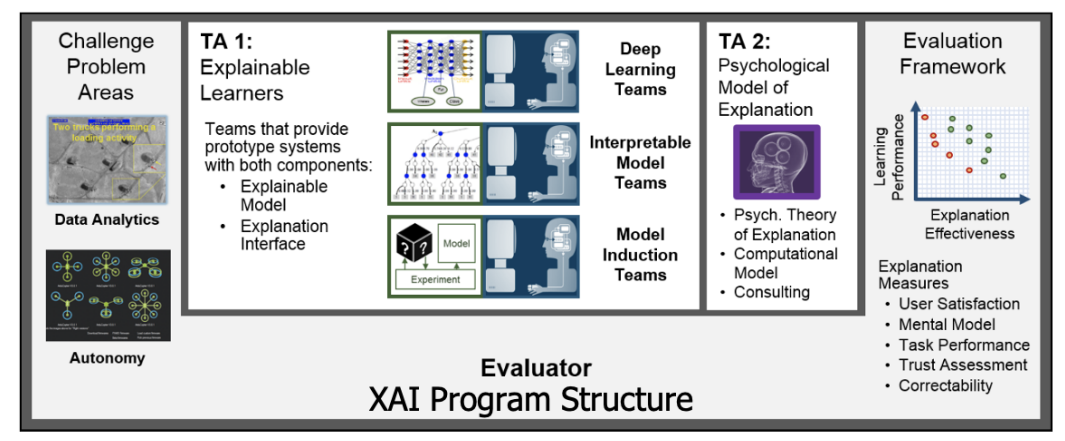

该计划分为三个主要技术领域(technical areas,TAs),如图 1 所示:(1)开发新的 XAI 机器学习和可解释技术以产生有效的解释性;(2)通过总结、延伸和应用可解释心理学理论,来理解可解释心理;(3) 在两个挑战问题领域评估新的 XAI 技术:数据分析和自主性。

图1:DARPA的XAI计划结构,包括技术领域(TAs)和评估框架

文章标题:

DARPA's explainable AI (XAI) program: A retrospective

文章链接:

https://onlinelibrary.wiley.com/doi/full/10.1002/ail2.61

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢