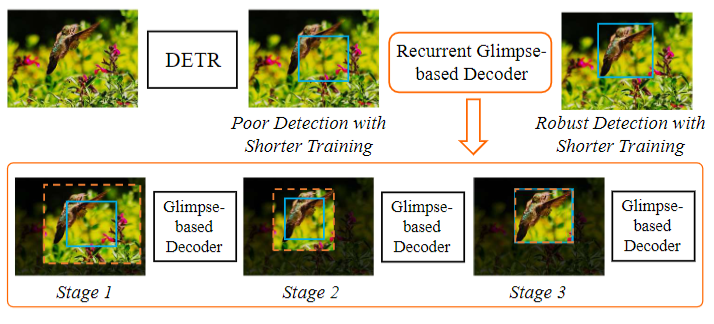

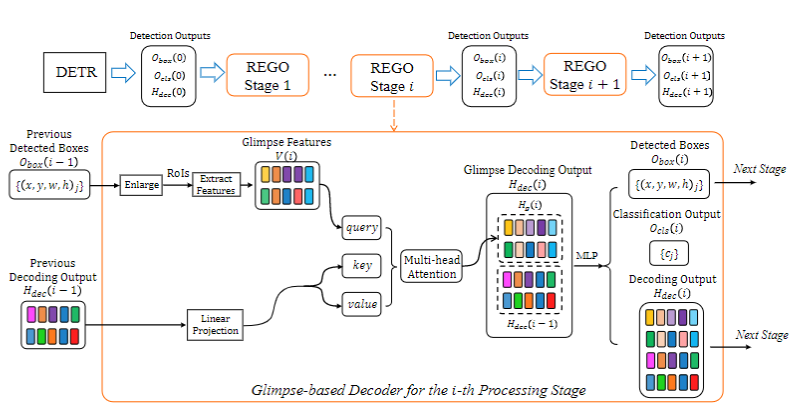

本工作由京东探索研究院和悉尼大学联合完成,已经被CVPR 2022 接收,并获得口头报告(oral)展示机会。在本文中,我们提出了一个利用递归“瞥视”解码器的方法来利用兴趣区域信息,从而有效加速基于Transformer的目标检测算法。具体来说,我们试图模仿人类的视觉感知过程并借助类似于“瞥视”的行为获取有关物体位置的大致信息,然后通过一个多阶段递归的处理过程,帮助模型逐渐地聚焦到正确的物体区域,从而较大程度上降低模型进行目标检测的难度,减少其所需的训练周期。在大数据集实验中,我们的方法被证明能减少30%左右当前最先进模型所需的训练周期且不会使目标检测的准确率下降。在使用相同训练周期的情况下,我们的方法也能进一步提升5%左右的检测准确率。

论文标题:

Recurrent Glimpse-based Decoder for Detection with Transformer

论文链接:

https://arxiv.org/abs/2112.04632

代码:

https://github.com/zhechen/Deformable-DETR-REGO

图1 递归“瞥视”解码器 (REGO: Recurrent Glimpsed-based Decoder) 的概念展示。

图2 递归“瞥视”解码器(REGO)每一阶段的处理框架图

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢