作者:Michael Strobl, Amine Trabelsi, Osmar Zaiane

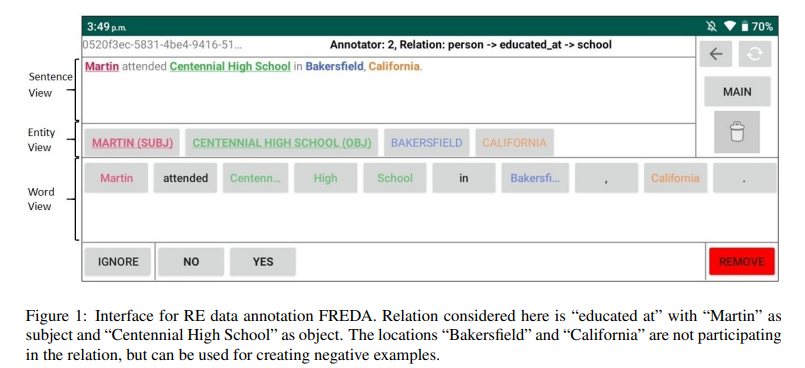

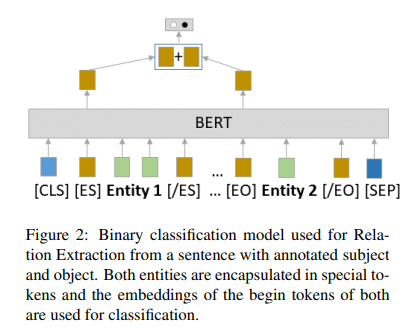

简介:本文研究基于BERT优化的模型高效高质量生成关系抽取数据集。为了有效地训练精确的关系抽取模型,需要足够且正确标记的数据。很难获得充分标记的数据,对此类数据进行注释是一项棘手的任务。如果做得准确,以前的工作表明:要么必须牺牲准确性,要么任务非常耗时。作者提出一种方法,以便快速生成用于关系提取任务的高质量数据集。神经模型经过训练,可以在创建的数据集上进行关系提取,取得了很好的效果,并且可以很好地推广到其他数据集。在该研究中,作者能够在合理的时间内为19种关系注释10022个句子,并为每种关系训练一个常用的基线模型。

论文下载:https://arxiv.org/pdf/2204.07150.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢