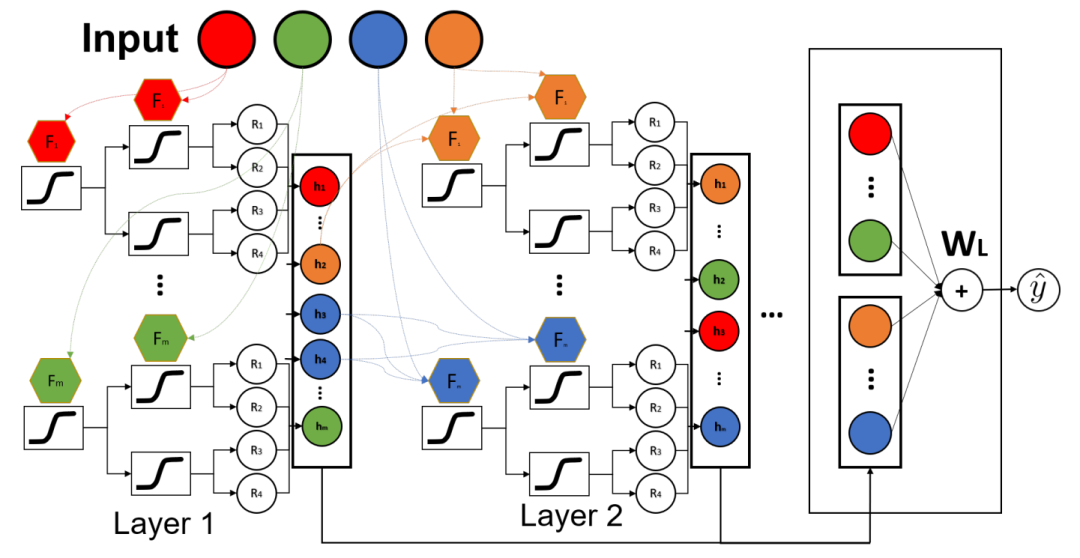

本文分享加拿大多伦多大学研究团队近期发表在ICLR2022上的一篇文章:《NODE-GAM: Neural Generated Additive Model for Interpretable Deep Learning》。在本文中,作者提出了一个深度学习版本的GAM和GA2M,它可以自动学习哪些主要的和成对的交互需要聚焦。作者的模型在大型数据集和有限标签设置中也比传统的GAMs更精确。作者希望这项工作能进一步启发其他可解释的深度学习模型设计。

论文链接:

https://arxiv.org/pdf/2106.01613.pdf?ref=https://githubhelp.com

摘要:

在真实的高风险环境(如医疗保健)中部署机器学习模型,通常不仅取决于模型的准确性,还取决于其公平性、健壮性和可解释性。广义加性模型(GAMs)是一类可解释的模型,在这些高风险领域有着悠久的使用历史,但它们缺乏深度学习所需要的特征,如可微性和可扩展性。在这项工作中,作者提出了一种神经GAM (NODE-GAM)和神经GA2M (NODEGA2M),它们在大数据集上比其他GAM具有更好的扩展性和性能,同时与其他集成和深度学习模型相比仍具有可解释性。作者展示了该模型在数据中发现了有趣的模式。最后,实验证明可以通过自监督的预训练来提高模型的准确性,而这种改进对于不可微GAMs是不可能的。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢