导读:本文介绍三篇发表在WWW 2022图扩展性相关的论文,他们或将训练速度提高了17 倍, 或提出一种广义前推(GFPush)算法来预先计算一个通用传播矩阵,并使用它以小批量方式执行图数据增强,或解决大规模不平衡图数据使用具有不平衡感知奖励功能的强化学习代理有效地从多数类和少数类中采样, 都非常值得关注。

大型图卷积网络的高效训练(模型的训练速度提高了17 倍)

题目:Resource-Efficient Training for Large Graph Convolutional Networks with Label-Centric Cumulative Sampling

作者:Mingkai Lin , Wenzhong Li , Ding Li , Yizhou Chen , Sanglu Lu

论文:https://dl.acm.org/doi/10.1145/3485447.3512165

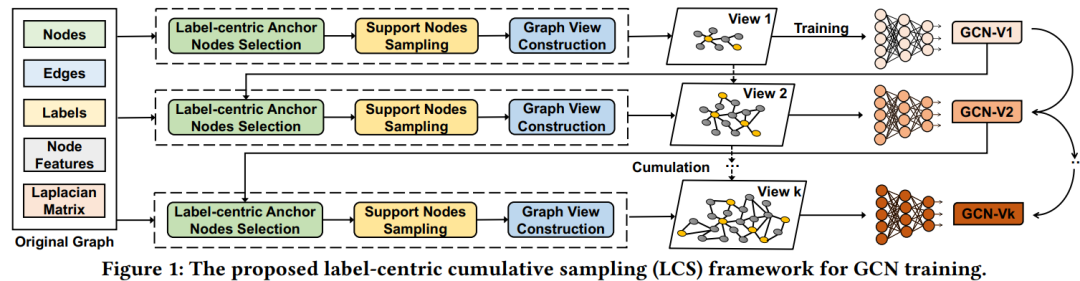

图卷积网络(GCN)在学习图数据表示方面很受欢迎,在社交网络、推荐系统等方面有着广泛的应用。但是,为大型网络训练 GCN 模型是资源密集型和耗时的,这阻碍了它们在实际的应用。现有的 GCN 训练方法旨在优化随机梯度下降的 mini-batch 的采样以加速训练过程,这并没有减少问题的规模,并且计算复杂度的降低有限。在本文中,作者认为可以使用采样子图训练 GCN 以产生近似的节点表示,作者提出了一个以标签为中心的累积采样 (Label-Centric Cumulative Sampling, LCS) 框架,用于训练大图的 GCN。该方法基于概率采样累积构建子图,并迭代训练 GCN 模型以生成近似节点表示。LCS 的最优性在理论上保证了在 GCN 训练中的节点聚合过程中最小化偏差。基于四个真实世界网络数据集的大量实验表明,LCS 框架将最先进的 GCN 模型的训练速度提高了 17 倍,而不会导致显着的模型精度下降。

GRAND+:可扩展图随机神经网络

题目:GRAND+: Scalable Graph Random Neural Networks

作者:Wenzheng Feng , Yuxiao Dong , Tinglin Huang , Ziqi Yin , Xu Cheng , Evgeny Kharlamov , Jie Tang

论文:https://dl.acm.org/doi/10.1145/3485447.3512044

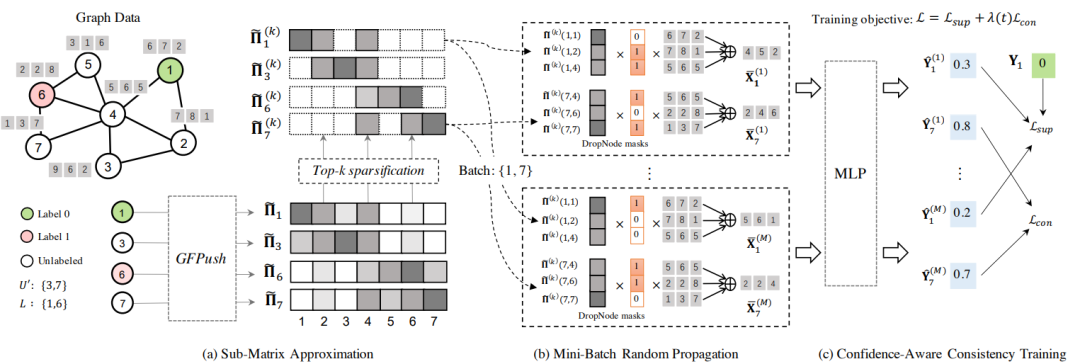

图神经网络(GNN)已被广泛用于图的半监督学习。最近的一项研究表明,图随机神经网络 (GRAND) 模型可以为这个问题产生最先进的性能。然而,GRAND 很难处理大规模图,因为它的有效性依赖于计算成本高昂的数据增强过程。在这项工作中,作者提出了一个可扩展的高性能 GNN 框架 GRAND+,用于半监督图学习。为了解决上述问题,作者在 GRAND+ 中开发了一种广义前推(GFPush)算法来预先计算一个通用传播矩阵,并使用它以小批量方式执行图数据增强。本文表明,GFPush 的低时间和空间复杂性使 GRAND+ 能够有效地扩展到大图。此外,作者在 GRAND+ 的模型优化中引入了置信度感知一致性损失,促进了 GRAND+ 的泛化优势。对七个不同大小的公共数据集进行了广泛的实验。结果表明,GRAND+ 1) 能够扩展到大型图并且比现有的可扩展 GNN 花费更少的运行时间,并且 2) 可以在所有数据集上对全批次和可扩展 GNN 提供一致的准确性改进。

GRAND+ 示意图。(a) GRAND+ 采用广义前推 (GFPush) 和 Top-k 稀疏化来近似 L ∪U ' 中节点的传播矩阵 。(b) 然后将获得的稀疏行近似值用于执行小批量随机传播,以生成批量中节点的增强。(c) 最后,将计算的特征增强输入 MLP 进行置信度感知一致性训练,该训练同时使用监督损失 Lsup 和置信度感知一致性损失 Lcon 进行模型优化.

ALLIE:大规模不平衡图上的主动学习(计算时间减少多达 38%)

题目:ALLIE: Active Learning on Large-scale Imbalanced Graphs

作者:Limeng Cui , Xianfeng Tang , Sumeet Katariya , Nikhil Rao , Pallav Agrawal , Karthik Subbian , Dongwon Lee

论文:https://dl.acm.org/doi/10.1145/3485447.3512229

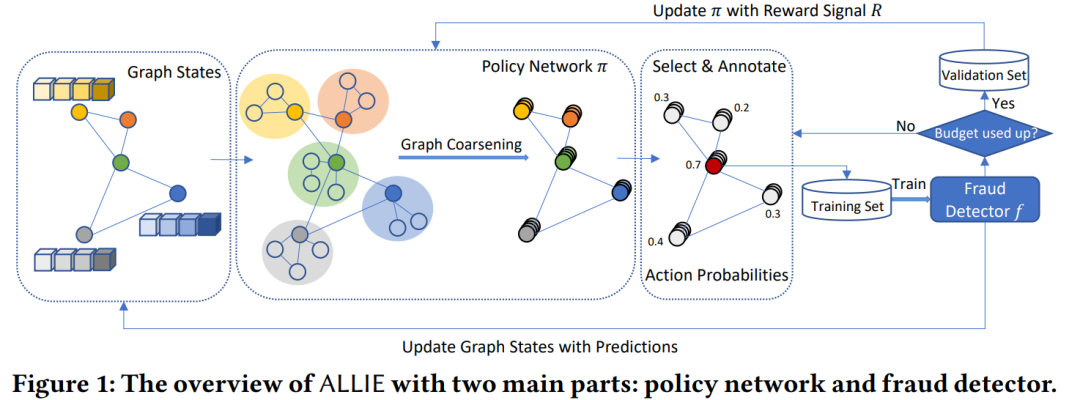

人工标记既费时又费钱。这个问题在极端不平衡的类别标签场景中进一步加剧,例如检测在线网站中的欺诈者。主动学习为人工标注者选择最相关的示例,以更低的成本提高模型性能。然而,现有的图数据主动学习方法通常假设数据和标签分布都是平衡的。这些假设在极端罕见的分类场景中失败,例如对电子商务网站中的滥用评论进行分类。本文提出了一个新的框架 ALLIE 来解决大规模不平衡图数据中主动学习的挑战。在该的方法中,作者使用具有不平衡感知奖励功能的强化学习代理有效地从多数类和少数类中采样。在节点分类模型中使用焦点损失,以便更多地关注稀有类并提高下游模型的准确性。最后,作者使用图粗化策略来减少强化学习代理的搜索空间。对基准图数据集和现实世界电子商务数据集进行了广泛的实验。ALLIE 显着优于最先进的基于图的主动学习方法,正类的 F1 分数提高了 10%。作者还通过指定其检测滥用行为来验证 ALLIE 在专有电子商务图数据上的有效性。作者的粗化策略可将专有和公共数据集的计算时间减少多达 38%。

ALLIE 的概述有两个主要部分:策略网络和欺诈检测器。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢