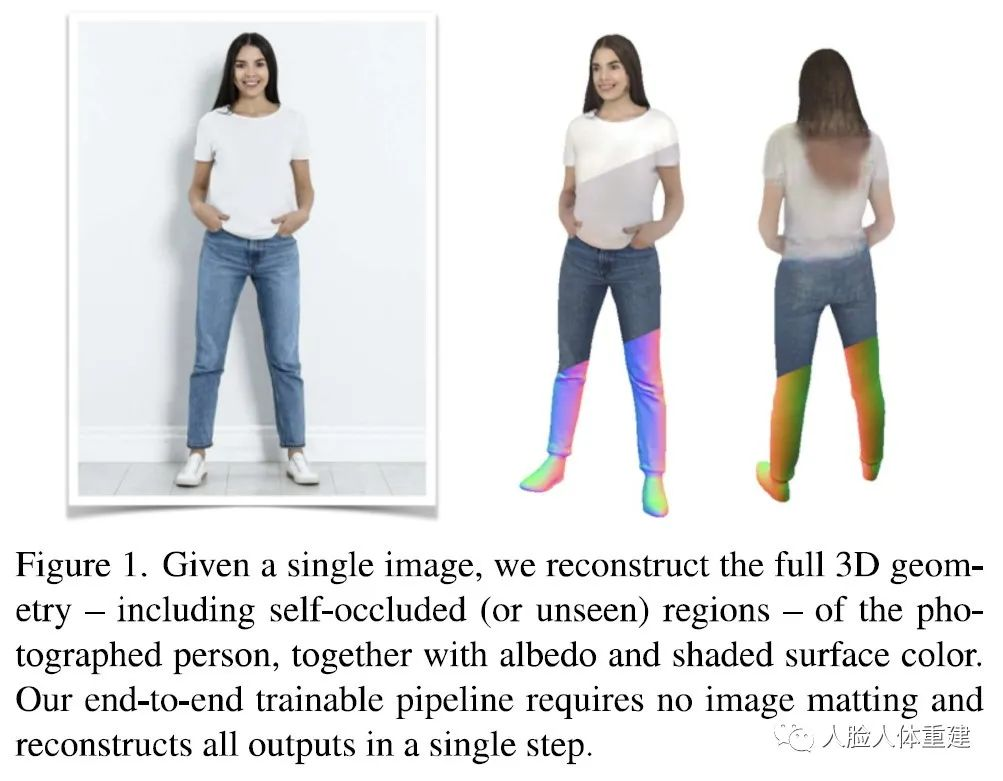

本文作者均来自 Google Research,作者提出了一个新颖的端到端的深度神经网络来从单张彩色图片重建具有真实感的穿着衣服的人体 3D 模型。

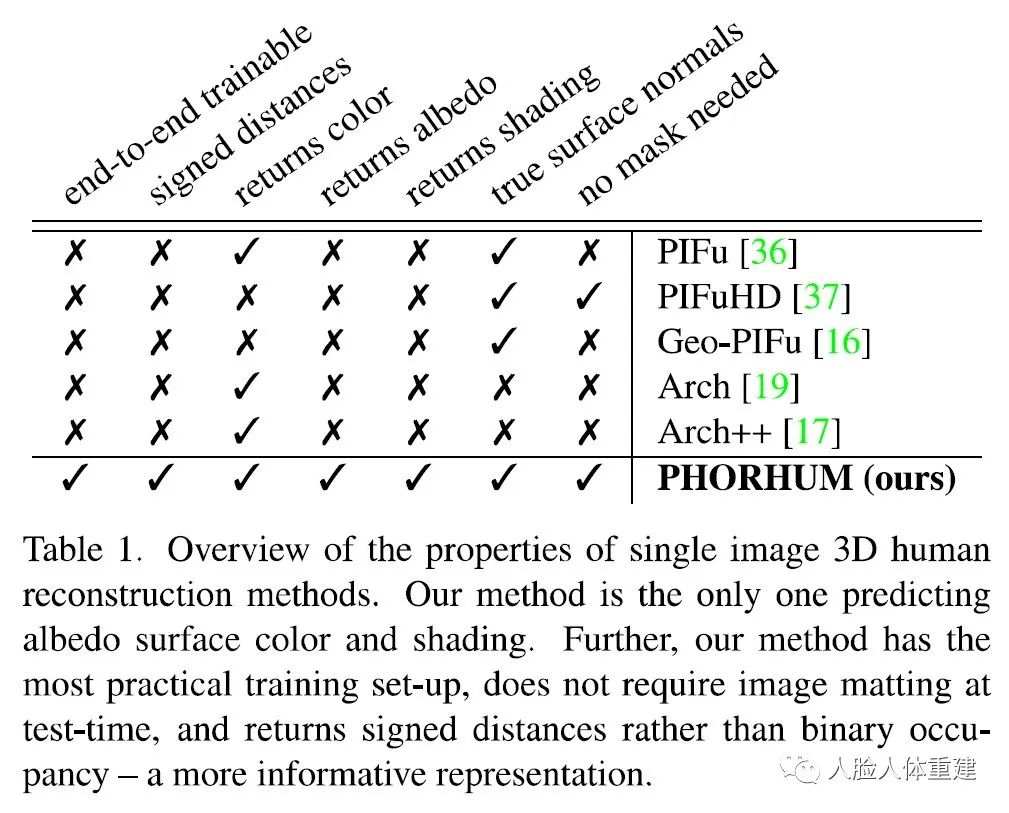

从单张图片重建人体的 3D 模型是近几年来的一个研究热点,出现了诸如 PIFu、PIFuHD、PAMIR、ARCH、ARCH++ 等众多优秀方法,但这些方法都存在一些问题,首先这些方法预测的人体外观都包含光照信息,有些方法根本不生成颜色信息,这样重建的模型就无法真实地放置在虚拟场景中。此外,许多方法都包含多个步骤,需要先计算一些中间表示,这就给计算和内存提出了更高要求。在大多数现有方法中,颜色都是在几何之后的步骤估计的,但从方法论的角度来看,本文作者认为应该同时计算几何形状和表面颜色,因为阴影 (shading) 是表面几何的一个强有力的线索,且无法解耦。

考虑到当前方法的这些缺点,作者提出了 PHORHUM,一个端到端的解决方案,通过一个深度神经网络同时预测人体的几何和外观。外观使用不带场景光照的反照率 (albedo) 颜色作为外观表达,此外,文章方法还能预测场景光照,使得光照和颜色的解耦变得可能。此外,作者发现使用稀疏的 3D 信息作为监督会得到不够真实地结果,为此作者引入了渲染损失来提高预测的外观的质量。文章的贡献主要在以下几点:

- 提出了一个端到端的高质量人体重建方法,能够取得比当前 SOTA 更加准确、更多细节的重建结果;

- 首次计算出人体的 albedo 和 shading 信息;

- 提出了渲染损失,极大地改善了预测的外观的真实性。

总的来说,PHORHUM 使用透视相机模型、无需去除背景、能够重建反照率、能够估计光照,只需一个人体检测器,裁剪出人体部分送入网络便可得到重建结果。

下面表格展示了文章方法与当前众多方法的对比

主页:https://phorhum.github.io/

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢