本文档包含加州大学伯克利分校机器学习Jonathan Shewchuk入门课程的课堂讲稿。它涵盖了许多分类和回归的方法,以及聚类和降维的方法。简洁明了,是非常合适的机器学习入门学习材料。

教程下载:https://people.eecs.berkeley.edu/~jrs/papers/machlearn.pdf

内容目录包括:

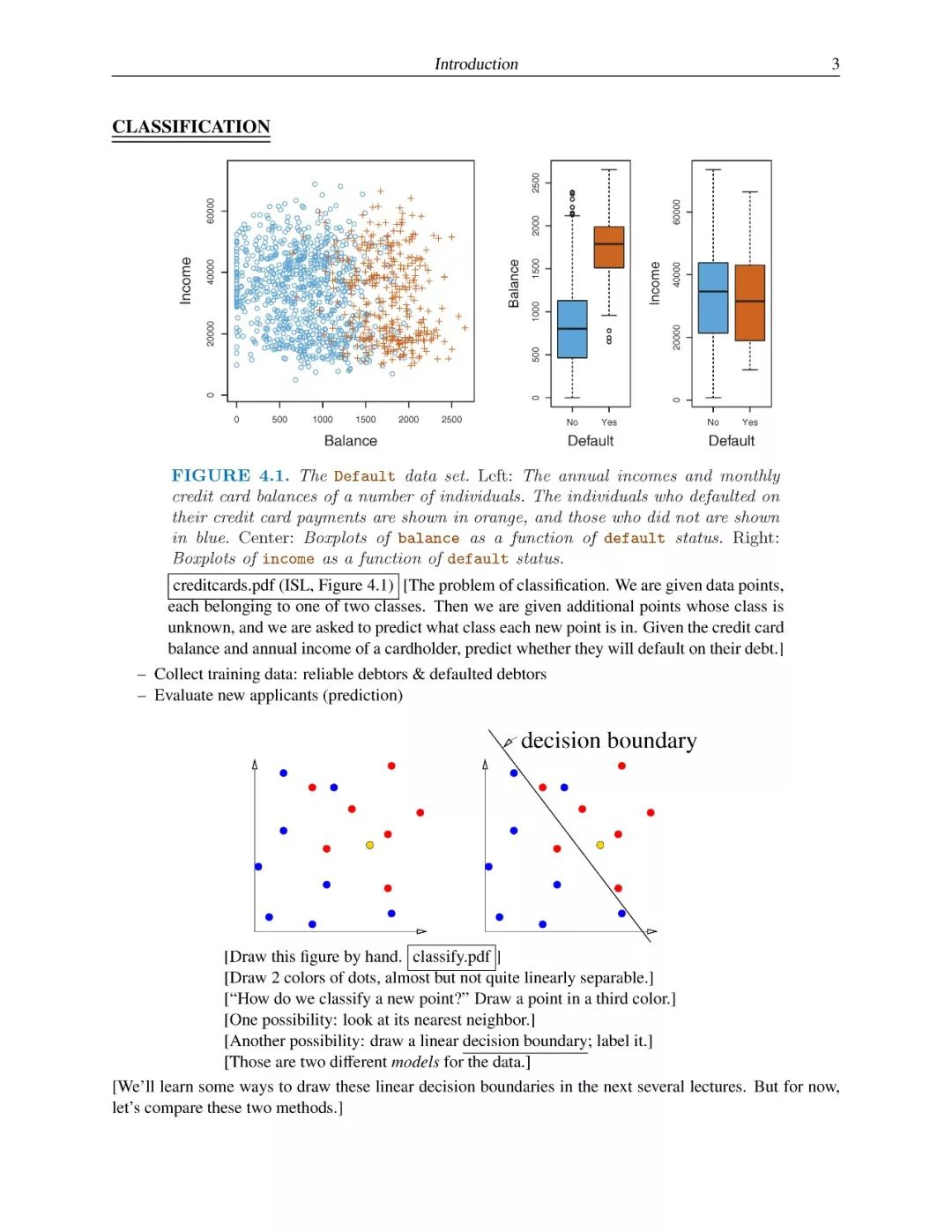

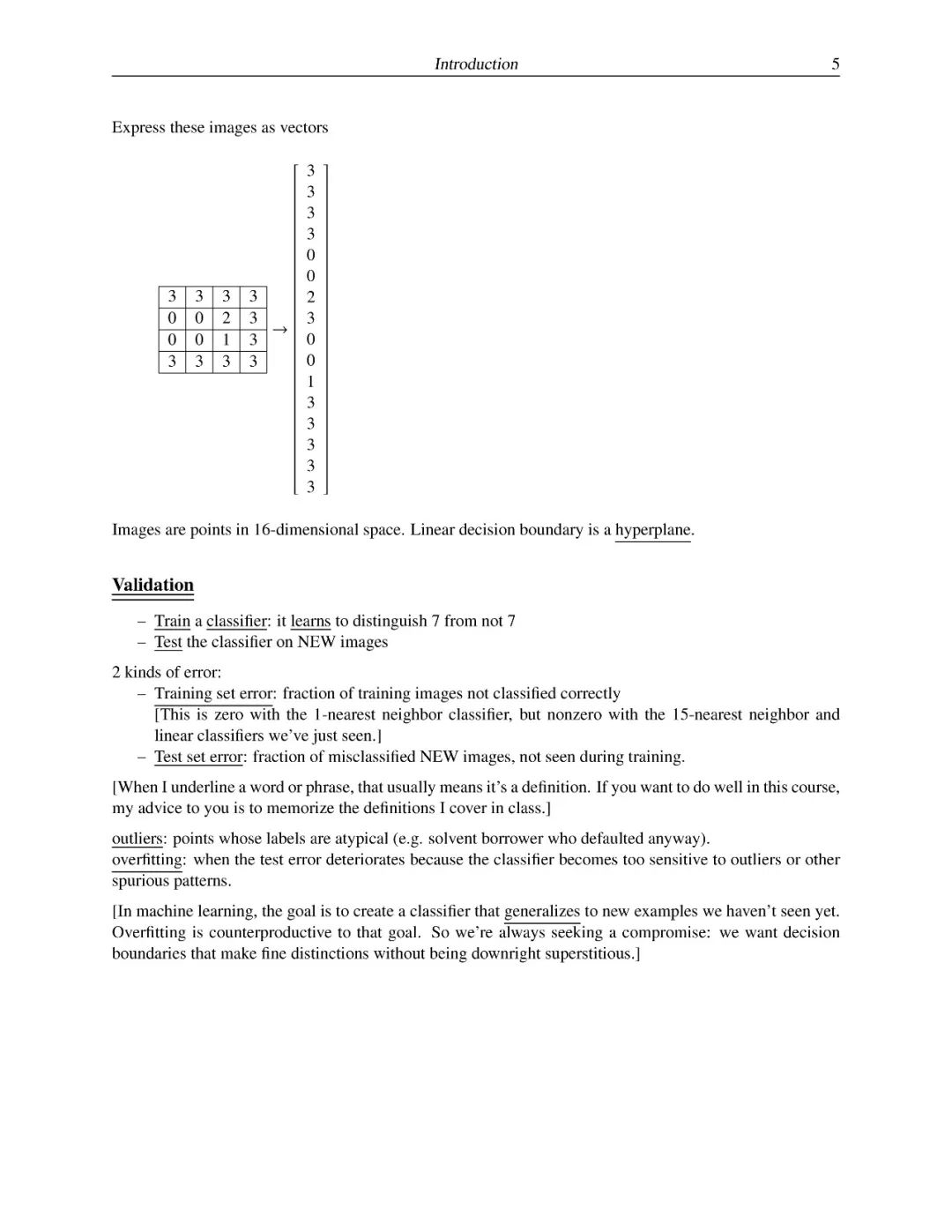

- 介绍

- 线性分类器和感知器

- 感知器学习;最大边缘分类器

- 软边缘支持向量机;特性

- 机器学习抽象和数值优化

- 决策理论;生成和判别模型

- 高斯判别分析,包括QDA和LDA

- 特征向量与各向异性多元正态分布

- 各向异性高斯,最大似然估计,QDA和LDA

- 回归,包括最小二乘线性回归和逻辑回归

- 更多的回归;牛顿法;ROC曲线

- 统计的理由;偏见方差分解

- 收缩:脊线回归,子集选择,套索

- 内核的诀窍

- 决策树

- 更多的决策树、集成学习和随机森林

- 神经网络

- 神经元;神经网络的变化

- 更好的神经网络训练;卷积神经网络

- 无监督学习与主成分分析

- 奇异值分解;聚类

- 光谱图聚类

- 学习理论

- 多个特征向量;潜在的因素分析;最近的邻居

- 更快的最近邻居:Voronoi图和k-d树

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢