不知道大家有没有注意过这个现象:随着年轻一代开始步入科研的道路,学术论文的画风也越来越有趣。在自然语言处理领域可以看到,从科幻电影中的Transformer,再到儿童教育节目《芝麻街》中的BERT、ELMo、ERNIE和Big Bird,越来越多的论文作者冲破论文命名需要严肃的桎梏,给自己的模型起一些富有趣味且朗朗上口的简称,让读者可以迅速记住自己的模型,同时这些模型也不负众望地在其研究领域占据了主流地位。

今天这篇文章的作者就在论文配图上别出心裁,给我们诠释了一位小猪佩奇爱好者在CV领域进行研究时,配图画风究竟会有多可爱。作者首次提出域信息和类别信息的解耦表达,利用双对抗网络结构学习较有影响力的类别信息。

论文题目:Learning Disentangled Semantic Representation for Domain Adaptation

论文链接:https://www.ijcai.org/proceedings/2019/285

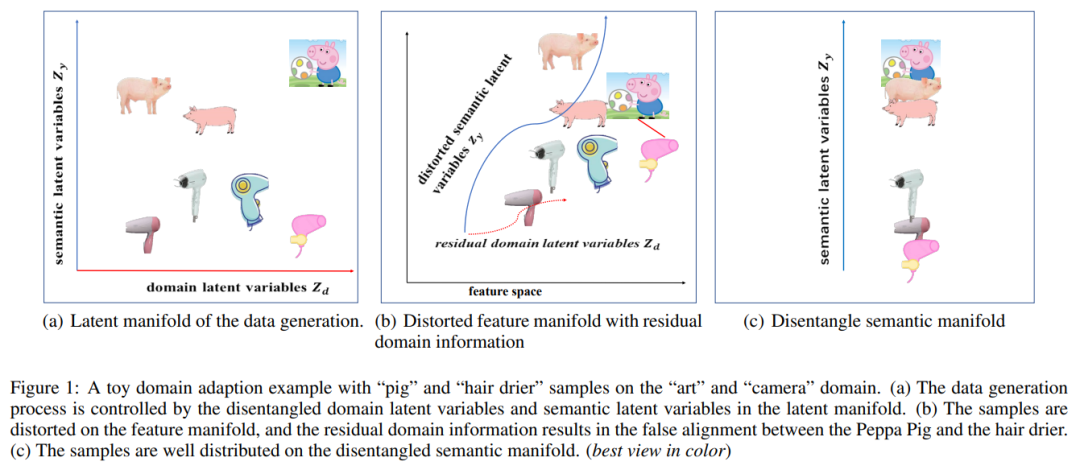

点开这篇论文时,最吸引目光的无疑是这张问题图,作者借助小猪佩奇和吹风机这两类毫不相干却又有一定联系的样本,引出了本文要研究的问题。

▲玩具的域适应示例

作者指出,现有的域自适应方法无法从特征空间提取具有域耦合信息和语义信息的域不变表示,因此作者提出了用潜在可解耦语义表示(latent disentangled semantic representation)来扩展语义信息。本文引出了以下两个问题:

- 跨域问题中,域的不变性表示是什么?

- 如何设计一个模型来提炼域的不变性表示?

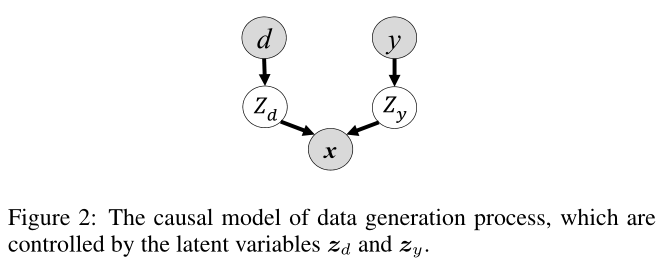

针对第一个问题,作者从数据生成过程背后的因果机制入手,如下图所示,给定由两个独立的潜在变量生成的 x,其中域潜在变量zd对域信息编码,语义潜在变量zy对语义信息编码,并且假设两者相互独立。作者还考虑到域信息在不同域之间可能存在很大差异,因此推断语义潜在变量在提取域不变表示中起着重要作用。

▲数据生成过程的因果模型

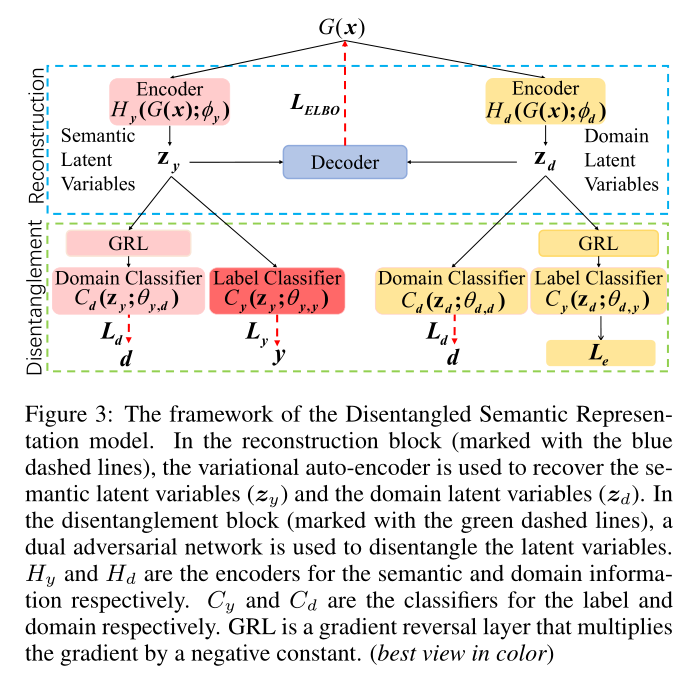

对于第二个问题,利用上述数据生成机制,作者提出了一种可解耦语义表示 (Disentangled Semantic Representation, DSR) 的域适应框架,如下图所示,其中Hy和Hd分别是语义和域信息的编码器。首先通过变分自编码器重构两个独立的潜在变量,然后通过双对抗训练网络来解耦合。

▲可解耦语义表示模型的框架

在重建块中,变分自编码器用于恢复语义潜在变量zy和域潜在变量zd。

在解耦合块中,使用双对抗网络对潜在变量解耦合。图的左侧是利用了语义潜在变量zy的标签对抗学习模块,融合了语义信息,并对域分类器Cd用梯度反转层 (GRL) 排除了所有的域信息。这是通过使用标签分类器Cy和域分类器Cd来完成的。图的右侧是域对抗学习模块,将域信息融合到zd中,并从zd中排除语义信息。同时将 GRL 用于标签分类器上,以便掌握来自zy的所有域信息。但与语义模块不同的是,作者没有用交叉熵作为标签损失,因为目标域中的无监督学习。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢