本文介绍了中科院计算所、上海交通大学等机构在 AAAI 2022 上发表的关于可解释生成对抗网络(GAN)的工作。该工作提出了一种将传统 GAN 修改为可解释 GAN 的通用方法,使得 GAN 生成器中间层的卷积核可以学习到解耦的局部视觉概念(例如人脸的眼睛、鼻子和嘴巴等部分)。每个卷积核在生成不同图像时可以稳定地生成对应于相同视觉概念的图像区域。可解释 GAN 使得人们可以通过操纵层中相应卷积核的特征图来修改生成图像上的特定视觉概念,为 GAN 生成图像的可控编辑方法提供了一个新的角度。

论文链接:https://www.aaai.org/AAAI22Papers/AAAI-7931.LiC.pdf

作者单位:中国科学院计算技术研究所、上海交通大学、之江实验室

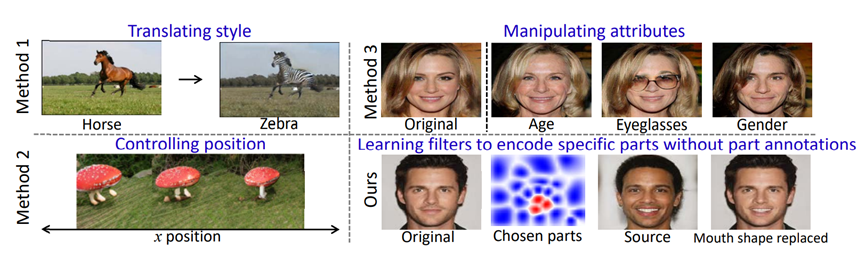

图 1:与其他 GAN 解耦表征方法的视觉对比

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢