作者:Yaru Hao, Haoyu Song, Li Dong,等。通信作者是韦福如。

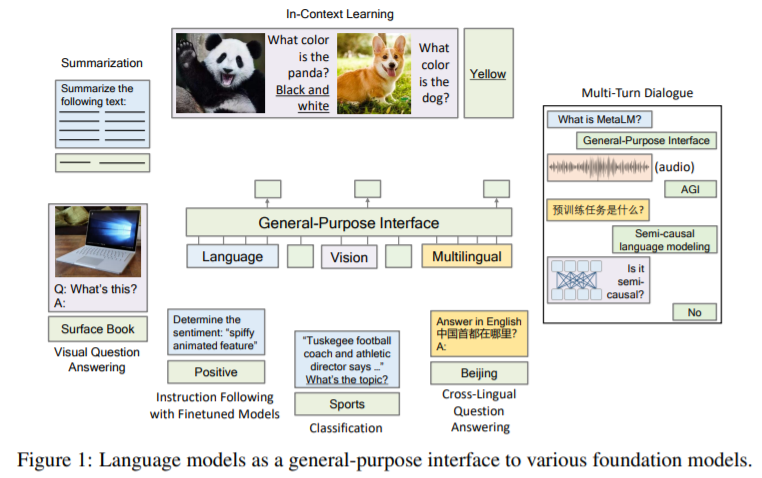

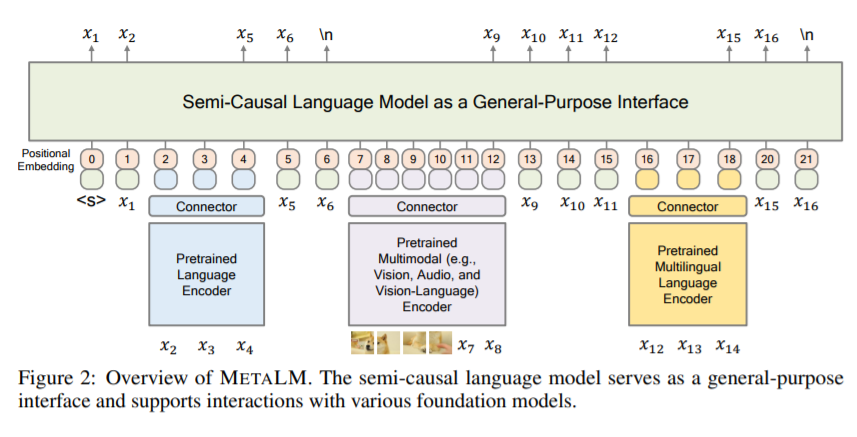

简介:本文研究如何将预训练语言模型作为基础模型的通用接口、并提出结合因果学习技术的策略。基础模型因其在广泛的下游应用中的有效性而备受关注。尽管在架构方面存在很大的融合,但大多数预训练模型通常仍是为特定任务或模式开发的。在这项工作中,作者建议使用语言模型作为各种基础模型的通用接口。一组预训练的编码器可以感知不同的模态(例如视觉和语言),并且它们与扮演通用任务层角色的语言模型对接。作者提出了一个半因果语言建模目标来联合预训练接口和模块化编码器。作者包含了因果建模和非因果建模的优势和能力,从而结合了两个世界的优点。具体来说,所提出的方法不仅继承了因果语言建模的上下文学习和开放式生成的能力,而且由于双向编码器有利于微调。更重要的是,作者的方法无缝地解锁了上述功能的组合,例如,启用上下文学习或使用微调编码器进行指令跟踪。各种纯语言和视觉语言基准的实验结果表明,作者的模型在微调、零样本泛化和少样本学习方面优于或与专业模型竞争。

论文地址: https://arxiv.org/abs/2206.06336

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢