本文分享论文『Efficient U-Transformer with Boundary-Aware Loss for Action Segmentation』,由软件所&人大&腾讯提出第一个动作分割领域的纯Transformer 结构,通过U型Transformer结构实现高效的动作分割!

论文链接:

https://arxiv.org/abs/2205.13425

动作分类已经取得了很大进展,但从长时间的视频中分割和识别动作仍然是一个具有挑战性的问题。大多数最先进的方法侧重于设计基于时间卷积的模型,但对长期时间依赖性建模的局限性和时间卷积的灵活性限制了这些模型的潜力。

近年来,基于Transformer的模型以其灵活和强大的序列建模能力被应用于各种任务中。然而,由于缺乏inductive bias和处理长视频序列的低效性,限制了Transformer在动作分割中的应用。

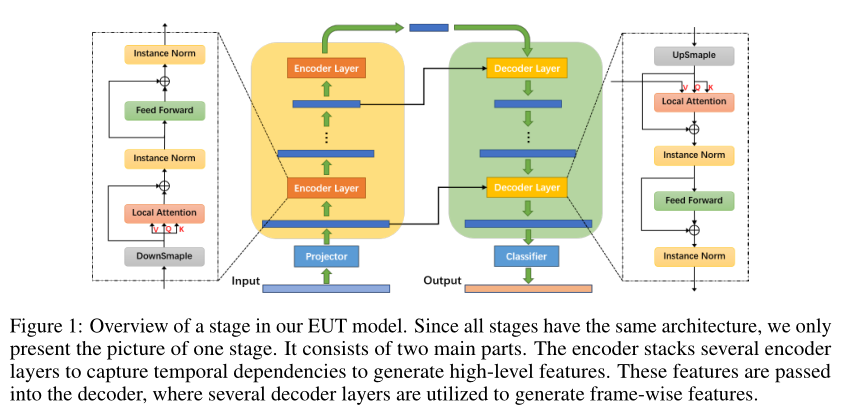

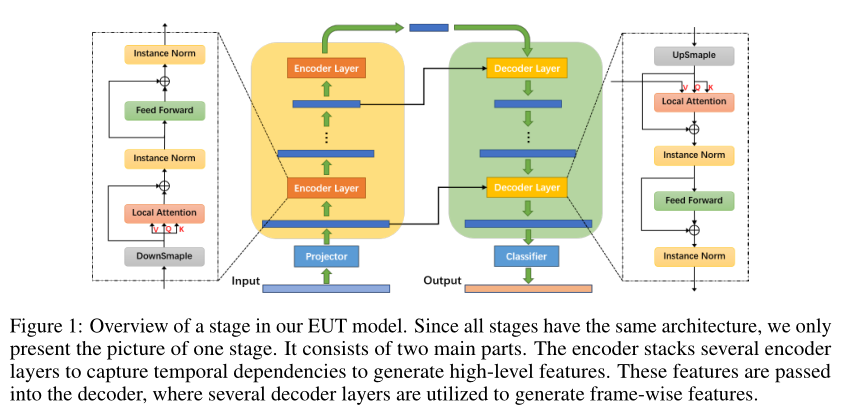

在本文中,作者结合U-Net架构设计了一个无时间卷积的纯Transformer模型。U-Transformer架构降低了复杂性,同时引入了一种inductive bias,即相邻帧更可能属于同一类。作者观察到,边界帧与其相邻帧之间的相似性分布取决于边界帧是动作片段的开始还是结束。因此,作者进一步提出了一种边界感知损失函数,以增强边界识别能力。大量实验表明了该模型的有效性。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢