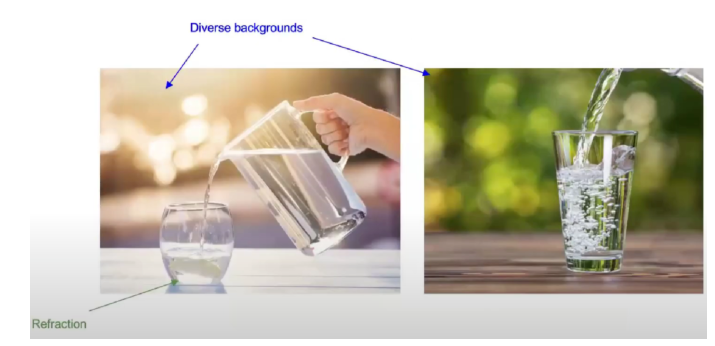

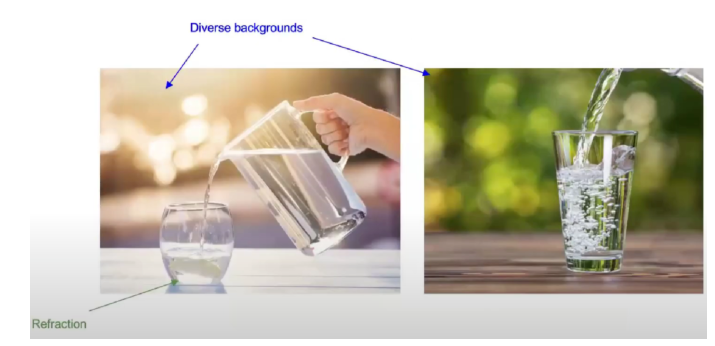

如果机器人可以倒液体,则可以帮助我们自动完成烹饪、将药品倒入药瓶或给植物浇水等任务。但是,透明液体在图像中很难被感知出来,完全透明的液体可以提供的唯一视觉信号是光线穿过液体的折射。此外,获得液体的深度测量同样不容易,因为液体会折射所投射的红外光。

以往的工作已经探索了机器人在各种环境下倒水,但都需要在环境或数据收集方法上做出重大妥协。透明液体细分的方法需要在训练期间加热液体,以在热成像仪观察下获得真值标签。

然而,为训练加热液体是一个单调乏味的过程,对可以轻松收集多少训练数据有限制。其他方法需要从多视角、背景、重量测量或液体运动等方面观察液体,这些施加在环境上的要求限制了这些方法的适用性。

近期,在 CMU 和圣母大学的一篇论文中,研究者提出了一种在透明容器中感知透明液体(如水)的方法。与以往方法相比,本研究提出的方法减轻了对操作域的限制。具体地,他们在单个图像上进行操作,不需要液体运动或多帧,也不需要在训练期间进行手动注释或加热液体。研究者使用一个生成模型来学习将有色液体的图像转换为透明液体的合成图像,这种做法可以用来训练透明的液体细分模型。

论文一作 Gautham Narasimhan 现为 CMU 机器人研究所的助理研究员,2020 年在 CMU 拿到了硕士学位。目前,他致力于研究用于机器人倒水任务的强化学习模型。该研究由 LG Electronics 和美国国家科学基金会提供资助,并于 5 月份发表在 IEEE 国际机器人和自动化会议上。该论文已被机器人领域国际顶会 ICRA 2022 接收。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢