【标题】Visuo-Tactile Manipulation Planning Using Reinforcement Learning with Affordance Representation

【作者团队】Wenyu Liang, Fen Fang, Cihan Acar, Wei Qi Toh, Ying Sun, Qianli Xu, Yan Wu

【发表日期】2022.7.14

【论文链接】https://arxiv.org/pdf/2207.06608.pdf

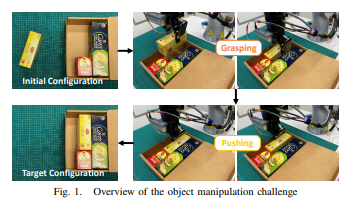

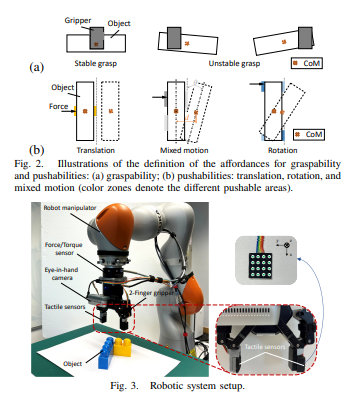

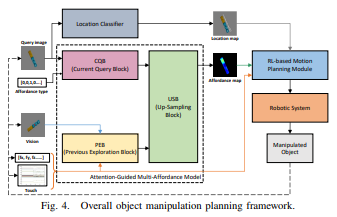

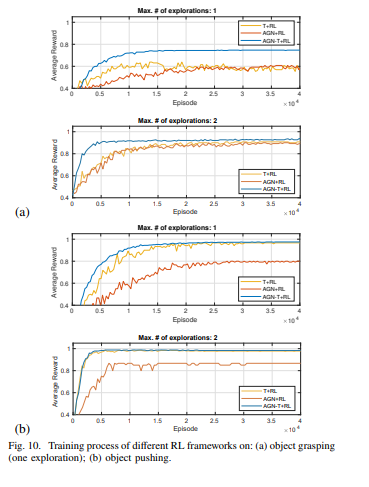

【推荐理由】人们越来越多地期望机器人在越来越非结构化的环境中操作对象,在这种环境中,任何单一感官模式的对象属性都具有高度的感知不确定性。这直接影响对象操作的成功。本文提出了基于强化学习的对象操作运动规划框架,其利用动态多传感器反馈和学习的注意力引导深度启示模型作为感知状态。可承受性模型是从多种感官模式中学习的,包括视觉和触觉(触觉和力/扭矩),其设计用于预测和指示具有相似外观但不同内在特性(例如质量分布)的物体的多种可承受性(即可抓取性和可推性)的可操作区域。然后训练基于DQN的深度强化学习算法,以选择成功操作对象的最佳动作。最后使用开放数据集和本文收集的数据集对该方法进行了评估和基准测试。结果表明,该方法和整体框架优于现有方法,具有更好的准确性和更高的效率。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢