前段时间,谷歌 AI在其新研究《LocoProp: Enhancing BackProp via Local Loss Optimization》中提出了一种用于多层神经网络的通用层级损失构造框架LocoProp,该框架在仅使用一阶优化器的同时实现了接近二阶方法的性能。

更具体来讲,该框架将一个神经网络重新构想为多层的模块化组合,其中每个层都使用自己的权重正则化器、目标输出和损失函数,最终同时实现了性能和效率。谷歌在基准模型和数据集上实验验证了其方法的有效性,缩小了一阶和二阶优化器之间的差距。

此外,谷歌研究者表示他们的局部损失构造方法是首次将平方损失用作局部损失。

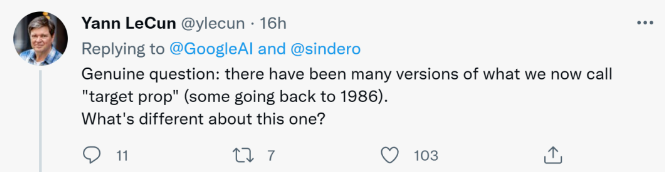

他认为,我们现在称为目标传播(target prop)的版本有很多,有些可以追溯至1986年。所以,谷歌的这个LocoProp与它们有什么区别呢?

图源:@Yann LeCun

图源:@Yann LeCun内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢