【标题】AACC: Asymmetric Actor-Critic in Contextual Reinforcement Learning

【作者团队】Wangyang Yue, Yuan Zhou, Xiaochuan Zhang, Yuchen Hua, Zhiyuan Wang, Guang Kou

【发表日期】2022.8.3

【论文链接】https://arxiv.org/pdf/2208.02376.pdf

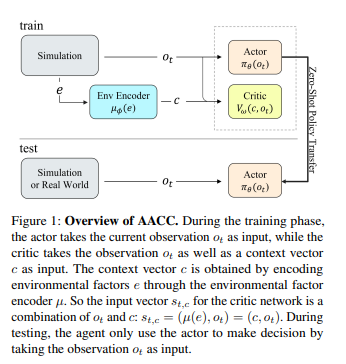

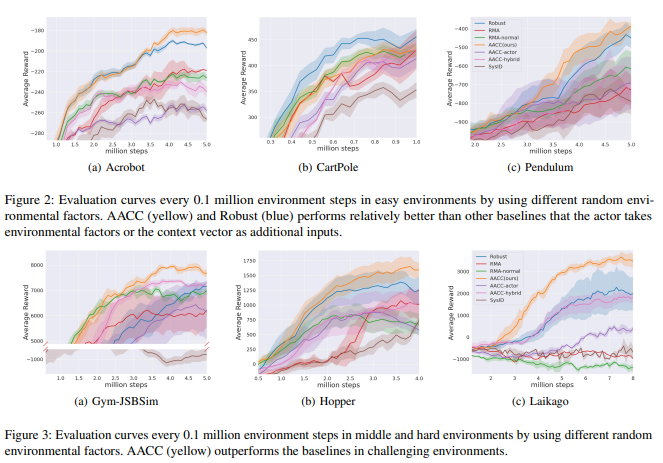

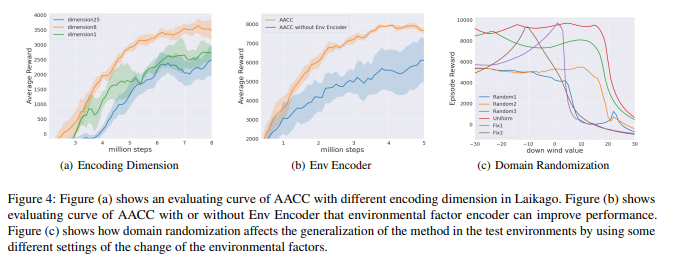

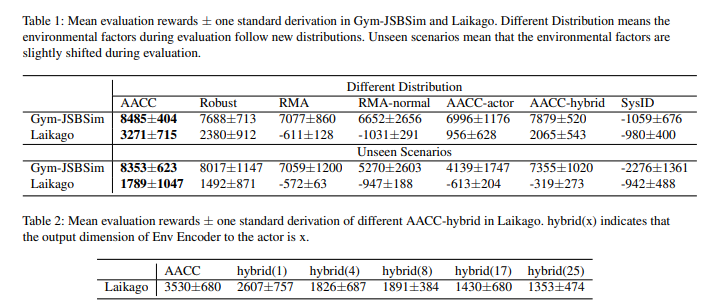

【推荐理由】强化学习(RL)技术在许多具有挑战性的任务中备受关注,但当应用于现实问题时,其性能会显著下降。已经提出了各种方法,例如域随机化,通过在不同的环境设置下训练智能体来处理这种情况,因此可以在部署期间将它们推广到不同的环境。然而,它们通常不包含智能体正确交互的潜在环境因素信息,因此在面对环境变化时可能过于保守。本文首先使用上下文马尔可夫决策过程(CMDP)将RL中适应环境动态变化的任务形式化为一个泛化问题。然后,提出了上下文强化学习中的非对称 Actor-Critic(AACC)作为一种端到端的 Actor-Critic 方法来处理此类泛化任务。最后在一系列模拟环境中通过实验证明了AACC在性能上比现有基线有本质的改进。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢