论文链接:https://arxiv.org/pdf/2208.04309.pdf

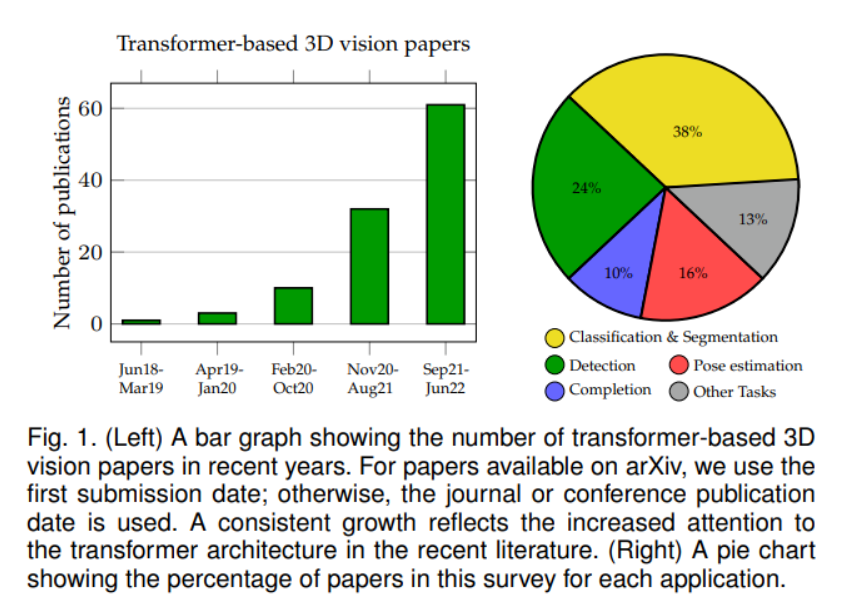

Transformer结构在自然语言处理中的成功引起了计算机视觉领域的关注。由于Transformer 具有学习远程依赖关系的能力,它已被用作广泛使用的卷积算子的替代。这种替代被证明在许多任务中都是成功的,其中一些最先进的方法依赖于Transformer来更好地学习。在计算机视觉领域,3D领域也越来越多地采用Transformer用于三维卷积神经网络和多层感知器网络。虽然很多综述都关注视觉中的Transformer,但与2D视觉相比,3D视觉在数据表示和处理方面存在差异,因此需要特别关注。在这项工作中,我们提出了一个超过100种Transformer方法的系统和全面的综述,不同的三维视觉任务,包括分类,分割,检测,完成,姿态估计,和其他。我们讨论了三维视觉中的Transformer设计,它允许用各种三维表示来处理数据。对于每个应用,我们强调了基于Transformer的方法的关键属性和贡献。为了评估这些方法的竞争力,我们在12个3D基准上将它们的性能与普通的非Transformer方法进行了比较。最后,我们讨论了Transformer在3D视觉中的不同开放方向和挑战。除了已发表的论文,我们的目标是经常更新最新的相关论文及其相应的实现:https://github.com/lahoud/3d-vision-transformers。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢