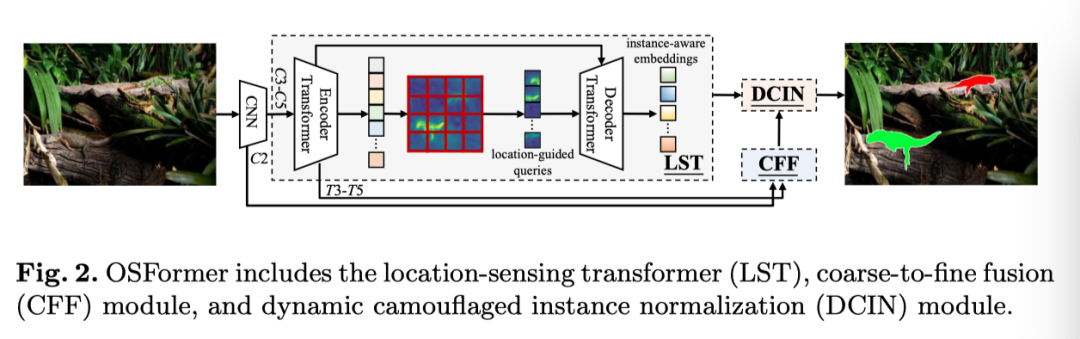

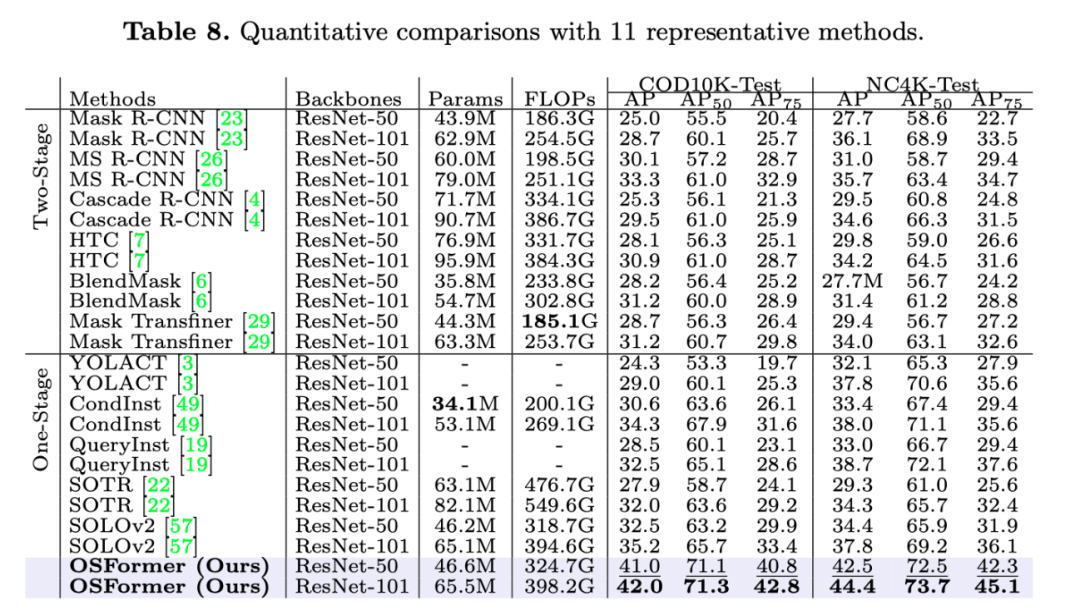

在本文中,作者提出了OSFormer,这是第一个用于伪装实例分割(CIS)的一阶段Transformer框架。OSFormer基于两个关键设计。首先,通过引入位置引导查询和混合卷积前馈网络,作者设计了一个位置感知Transformer(LST)来获取位置标签和实例感知参数。其次,作者开发了一种从粗到精的融合(CFF),以合并来自LST编码器和CNN主干的不同上下文信息。耦合这两个组件使OSFormer能够有效地混合局部特征和长期上下文依赖,以预测伪装实例。与两阶段框架相比,本文的OSFormer在不需要大量训练数据的情况下达到了41%的AP,并实现了良好的收敛效率。

本文的贡献如下:

-

提出了OSFormer,这是为伪装实例分割任务设计的第一个基于Transformer的一阶段框架。这是一个灵活的框架,可以端到端的方式进行训练。

-

提出了一种位置感知Transformer(LST)来动态捕捉不同位置的实例线索。本文的LST包含一个带有混合卷积前馈网络的编码器,用于提取多尺度全局特征,以及一个带有位置引导查询的解码器,用于实现实例感知嵌入。所提出的LST结构可以快速收敛到有限的训练数据。

-

提出了一种新的粗到细融合(CFF)方法,通过融合主干和LST块的多尺度低层和高层特征来获得高分辨率掩模。在该模块中,嵌入了反向边缘注意(REA),以突出伪装实例的边缘信息。

-

广泛的实验表明,OSFormer在具有挑战性的CIS任务中表现良好,在很大程度上优于11种流行的实例分割方法,例如,在COD10K测试集上实现了8.5% 的AP改进。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢