最近,Stability.Ai 公开发布了其文本生成图像模型 Stable Diffusion 的最新版本,网友们的新一波图像创作热潮又开始了~

前特斯拉 AI 总监 Andrej Karpathy 评论说:这是人类创造力具有历史意义的一天,如此丰富的人类视觉创造力集中体现到了一个人人可触及的产品中。

从生成图像的效果来看,Stable Diffusion 已经是当前最好的模型之一,而它背后的扩散模型(Diffusion Model)最近也备受关注,显示出要取代 GAN 模型的势头。

其实,自从 2015 年扩散模型首次被提出以来,该领域本身已经有非常多的研究,研究人员也提出不少变体。而日前,来自马里兰大学和纽约大学的团队提出了近来最新的一种扩散模型:Cold Diffusion。

目前业界出现的扩散模型变体层出不穷,但它们都有一个不变的核心:都是围绕随机噪声去除这个概念建立的。

扩散模型的本质,以及目前我们对扩散模型的理解,都与高斯噪声在训练和生成过程中所起的作用高度相关。我们可以将「扩散」理解为使用 Langevin 动力学围绕图像密度函数的随机移动,扩散的每一步都需要高斯噪声。扩散始于「高温」状态(即噪音很大的状态),然后逐渐降温到几乎没有噪音的「冷」状态。

而在这篇叫做“Cold Diffusion: Inverting Arbitrary Image Transforms Without Noise”的最新论文中,作者提出了一个疑问:制作扩散模型的变体,是不是非得使用高斯噪声不可?

论文地址:https://arxiv.org/pdf/2208.09392.pdf

通过多次尝试,该研究团队得出了答案:并不一定需要。

在这篇论文中,作者不再将扩散模型局限于「依赖高斯噪声而建立」,而是提出了围绕模糊(blurring)、下采样(downsampling)等任意图像变换方式建立的广义扩散模型。由于不再有原先的「高温」状态,这种全新广义扩散模型也就被称作为 Cold Diffusion。

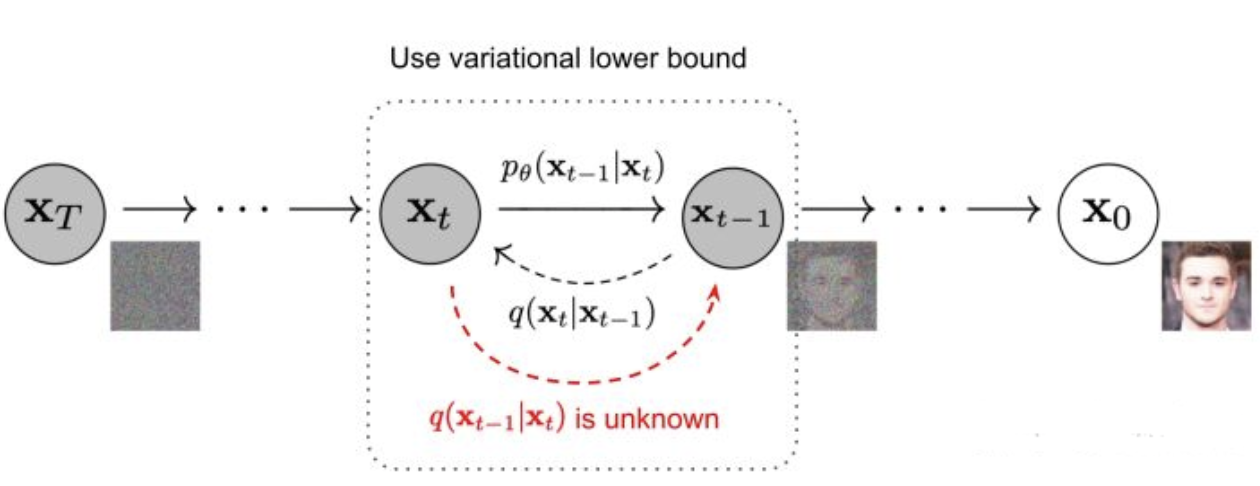

过去标准的扩散模型有两步工作流程:首先,用图像退化算子(image degradation operator)使得图像受到高斯噪声的污染,其次用一个训练好的恢复算子(restoration operator)对图像进行去噪,逆转退化,从而得到一张新图像。

图注:传统扩散模型的两步工作流程

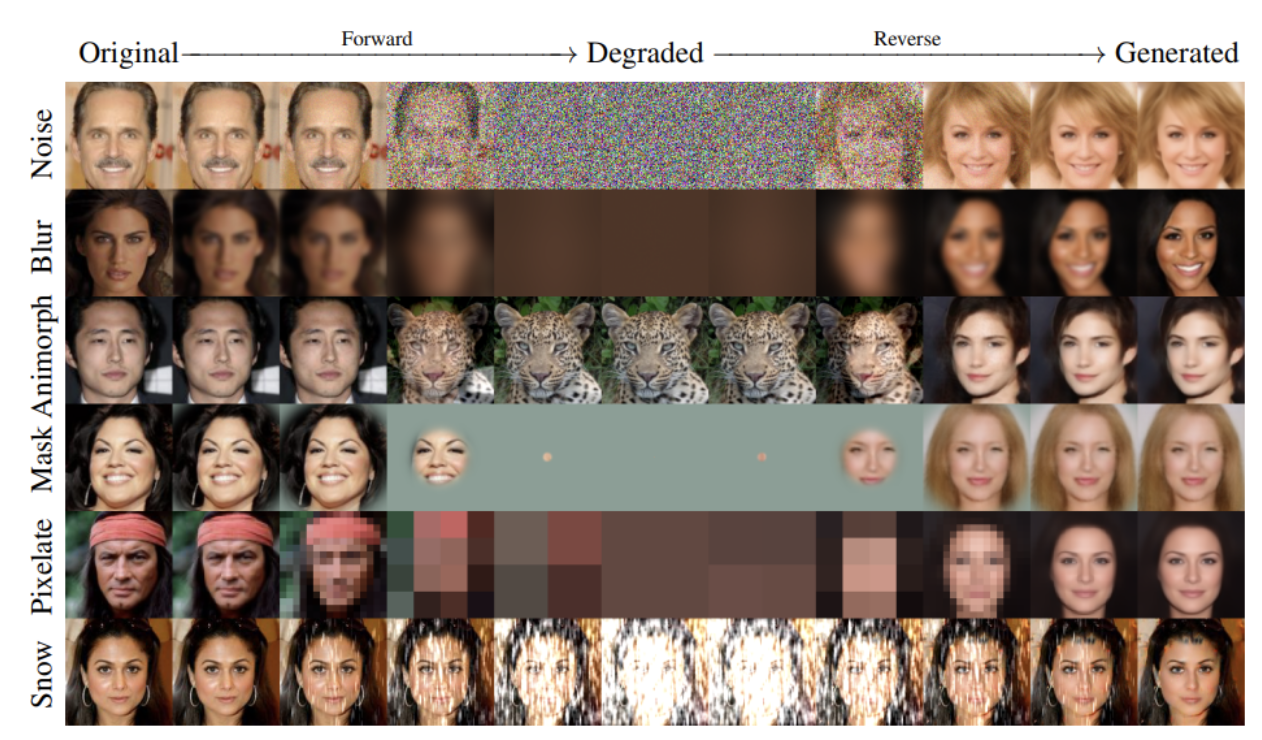

Cold Diffusion 继承了这两步工作流程,但又对之进行了升华式的修改。如下图所示,在图像退化再到逆转退化的过程中,Cold Diffusion 研究团队尝试了使用噪声、模糊、变形(Animorph)、遮罩(mask)、像素化(pixelate)、雪花等变换方式,且都得到了不错的效果。

图注:Cold Diffusion 使用不同图像变换方式得到新图像的工作流程

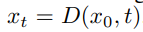

对于已知图像 x0,设图像退化算子为D,执行算子的次数为t。

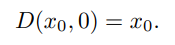

对以往标准的扩散模型来说,其执行图像变换的前向过程,是由图像退化算子 D 来对图像添加高斯噪声。添加0次时,D 应满足:

添加t次时,则应有:

而在 Cold Diffusion 的模型设计中,D 可以用来执行其他各种图像变换方式,如模糊、变形、像素化、雪花等,其退化程度取决于t ——Cold Diffusion 的「升级」正体现在可以进行包括噪音在内的多种图像变换。

同时我们还需要一个能把xt“变回”图像的恢复算子 R ,应有:

在有了图像退化算子 D 和 恢复算子 R 后,就可以借用扩散模型的标准方法对算子进行串联使用,从而实现退化运算-逆转退化的工作流程。如果退化运算的次数 t 比较小(t ≈ 0),对 R 进行一次应用就可以得到一幅恢复后的新图像。

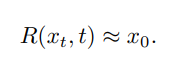

由于R通常只经过了一个简单的凸损失训练,当执行退化运算的次数 t 很大时,生成的结果会很模糊。对此,作者团队提出一个改进的 Cold Diffusion 采样算法来生成高质量图像。

变化无穷

这篇研究的重点就在于,作者观察到,扩散模型的图像生成并不完全依赖于高斯噪声,我们也可以选择其他图像变换方式来生成新图像。通过改变图像变换方式,甚至可以构建出整个生成模型家族。

以模糊为退化运算方式

基于噪声的扩散模型中的前向扩散过程(即退化运算这一步)的优点是,在最后一步 T 处的退化图像分布只是一个各向同性的高斯分布。因此,我们可以首先从各向同性高斯分布中抽取样本,然后通过反向扩散顺序对其进行去噪来执行(无条件)生成。而选择模糊这种退化运算时,完全退化的图像不能形成我们可以抽样的良好封闭式分布,但是可以形成一个足够简单的分布,可以用简单的方法进行建模。

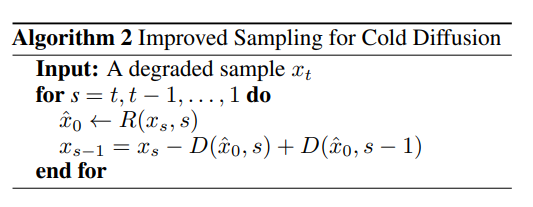

对于次数足够大的 T,每个图像 x0 都会降级为一个常数 xT(即每个像素都是相同的颜色)。该常数值恰好是 RGB 图像 x0 的通道平均值,可以表示为三维向量,并使用高斯混合模型 (Gaussian mixture model, GMM) 表示。通过对该 GMM 进行采样,可以产生高度模糊图像的随机像素值,然后使用 cold diffusion 就可以进行去模糊化,从而创建新图像。

另外,像素之间的对称性会导致生成的图像缺乏多样性,为了打破同一管道像素的对称性,作者向每个采样的 xT 添加少量高斯噪声,这个简单的技巧极大地提高了生成图像的丰富性。

图注:对128 × 128 CelebA and AFHQ 数据集使用 cold diffusion 的模糊方式变换生成样本示例

以其他图像变换为退化运算方式

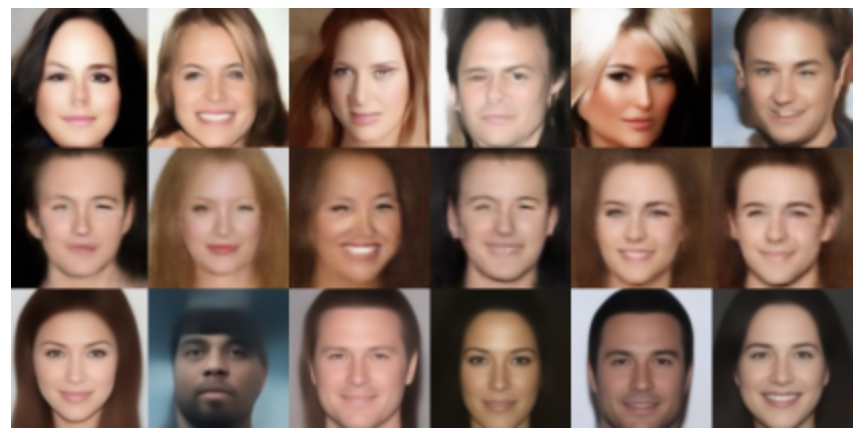

最后团队进一步证明,除了模糊方式以外,cold diffusion 还可以扩展到其他变换,如修复、超分辨率和变形(animorphosis)方式上,且生成的图像效果也都很好:

图注:cold diffusion 的生成图像。第一行使用变形方式变换,第二行使用修复方式变换,第三行使用超分辨率变换方式。

研究团队给出了 CelebA 数据集上的结果,cold diffusion 在修复、超分辨率和变形方面的 FID 得分分别为90.14、92.91和48.51。( FID,即 Rechet Inception Distance score,是用来计算真实图像和生成图像计算的特征向量之间距离的指标。)

在训练和测试期间不需要高斯噪声的 cold diffusion,突破了人们对扩散模型的原有理解,为新型生成模型打开了未来的大门。

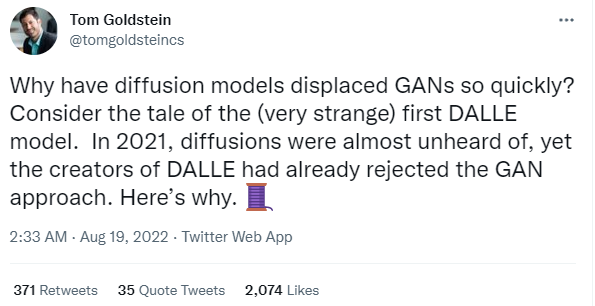

这项研究因为提出了一种不同于传统形式的扩散模型,而在近日登上了许多论文排行榜的热门,同样引起了热议的,还有论文其中一位作者在推特上发起的讨论:为什么扩散模型如此迅速地取代了 GAN?

马里兰大学副教授 Tom Goldstein 解释,扩散模型的优点是它可以最小化凸回归损失,所以 OpenAI 在开发 DALLE 时直接抛弃了 GAN,而使用扩散模型来解决不稳定的鞍点问题(saddle point problem)。

而且,他认为,扩散模型的成功是新数学范式发挥其作用的一个例子,世界上所有的超参数调整都比不过几行深思熟虑的数学公式。

要说今天的文本生成图像领域已经由扩散模型统治或许还不够严谨,但 GAN 的一家独大的确已经成为历史。归根结底,谁的图像生成质量和稳定性更好,谁才在越来越卷的生成模型界成为宠儿。这项工作提出的 Cold Diffusion,或许就会在不久之后为我们带来一个新的、强大的文本生成图像模型。

参考链接:

https://arxiv.org/pdf/2208.09392.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢