弱监督定位任务(Weakly supervised object localization, WSOL)仅利用图像级别的类别标签,就能实现目标级别的定位功能,因为其细粒度注释的最小化需求大大压缩了人工成本,于近年获得大量关注。

由于缺乏目标级别标签的约束,仅利用图像标签进行分类训练,弱监督定位方法往往倾向于只定位图像中最具判别性的局部区域,难以涵盖整个物体区域。弱监督定位方法的局部聚焦缺陷是否和卷积神经网络局部特征关联性相关?Transformer 类网络结构的长程依赖特性对弱监督定位有何影响?作者通过可视化分析 CAM 方法、纯 transformer 网络的长程特征依赖关系,发现 transformer 网络中的长程依赖有利于克服局部聚焦缺陷,却容易受到背景干扰。

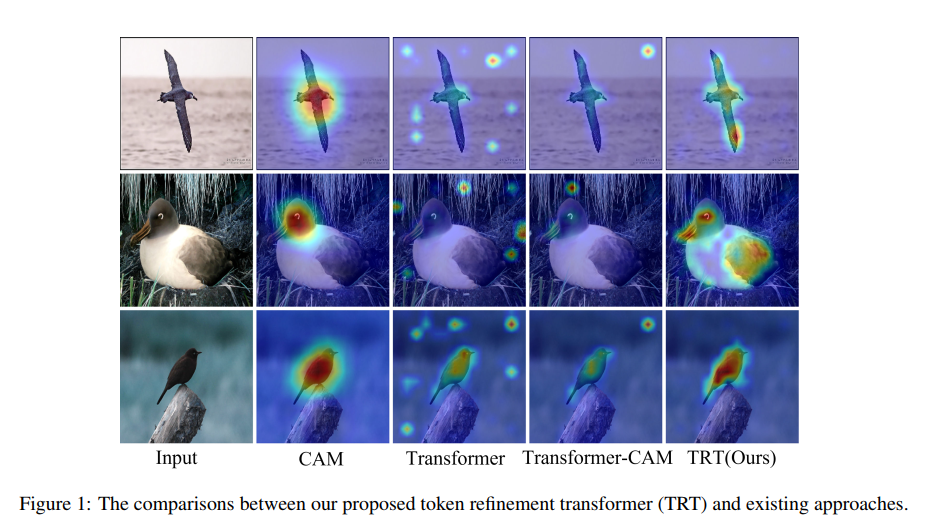

下图 1 展示了不同方法的可视化定位结果,可以看出 CAM 方法存在明显局部聚焦的问题;Transformer 的长程依赖容易产生背景误定位的现象;融合 Transformer 长程依赖和 CAM(参照 TS-CAM 论文方法)的方法虽然一定程度上缓解了局部聚焦和背景干扰的问题,但是问题依旧存在。

图 1:不同方法的可视化结果比对

基于此,来自之江实验室和浙江大学的研究者提出一种再注意机制,即 TRT (token refinement transformer),旨在更有效地捕捉目标级别的语义信息,抑制背景干扰,实现更准确的目标定位能力。

论文链接:https://arxiv.org/pdf/2208.01838.pdf

Github链接:https://github.com/su-hui-zz/ReAttentionTransformer

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢