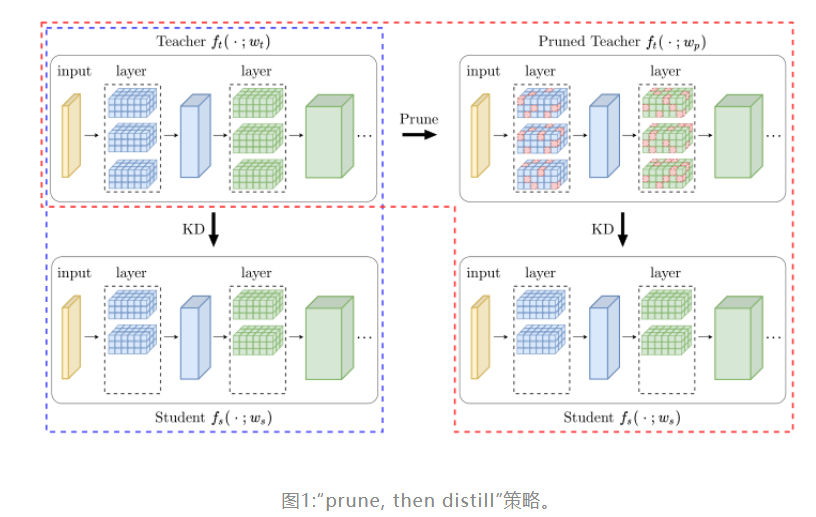

论文提出了一个新的框架,“prune, then distill”,该框架首先剪枝模型,使其更具可移植性,然后提取给student。并进一步从理论上证明了剪枝后的teacher在蒸馏中起到正则化器的作用,减少了泛化误差。

在此基础上,还提出了一种新的神经网络压缩方案,其中student网络是基于剪枝后的teacher,然后应用“prune, then distill”策略。

论文:https://arxiv.org/pdf/2109.14960.pdf

代码:https://github.com/ososos888/prune-then-distill

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢