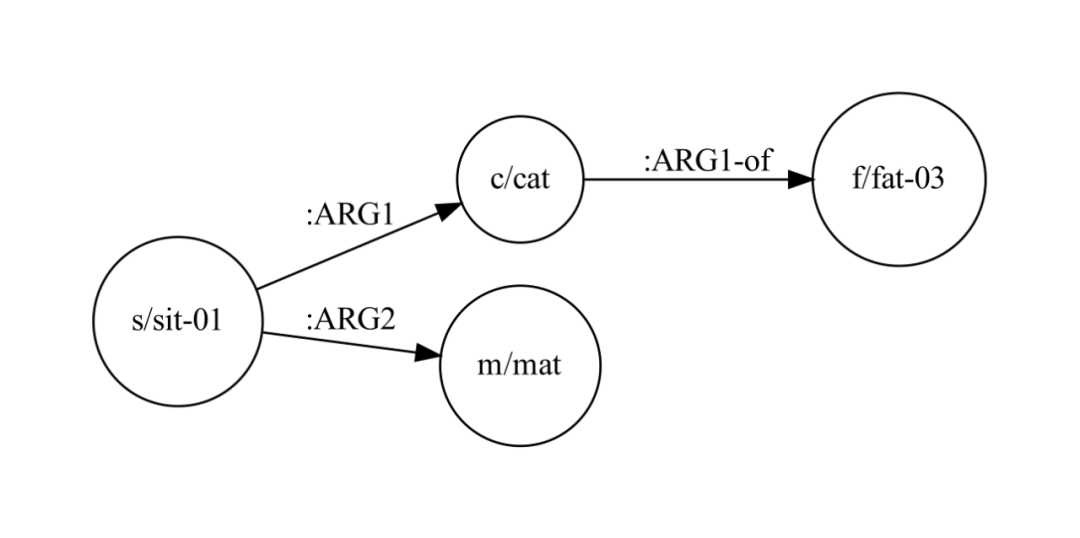

TreeBank 作为自然语言语法的结构化表示可谓广为人知,其实在语义层面也有一种类似的结构化方法——抽象语义表示(Abstract Meaning Representation,AMR)。它能记录自然语言文本中最重要的语义信息,但并不限制实际表达时的语法结构。本次分享我们将向读者介绍 ACL 2022 中与 AMR 有关的三篇论文,一窥 AMR 图谱在自然语言处理中的应用。

文章概览

-

Graph Pre-training for AMR Parsing and Generation

AMR 既不会自动从文本中展现出来,也无法自行表达一个句子。因此对于 AMR 而言,最重要的任务就是从文本中构建 AMR,以及根据 AMR 生成文本。目前的主流模型均以预训练语言模型作为基础,然而本文作者指出,传统的预训练方法面向文本,存在任务形式错配的问题。因此,本文首次提出将直接针对 AMR 的图预训练任务应用至预训练语言模型中,并取得了不错的效果。

-

Variational Graph Autoencoding as Cheap Supervision for AMR Coreference Resolution

理论上我们可以利用 AMR 图谱分析多个句子甚至一篇文章的语义,但必须通过指代消融将多个指代相同实体的节点合并。目前的模型一方面需要大量的图谱数据用于训练,另一方面却对数据噪声较为敏感。本文作者通过将变分图自编码器引入既有的 AMR 指代消融模型,成功将存在一定错误的自动标注 AMR 图谱数据纳入训练数据中,使模型性能得到了显著提高。

-

AMR-DA: Data Augmentation by Abstract Meaning Representation

AMR 图谱可以助力多种自然语言处理任务,不过本文探讨的却是一个比较另类的应用——自然语言数据增强。面向文本的数据增强方法或者容易导致病句,或者难以提供足够的数据多样性;相反,面向 AMR 的数据增强可以在轻微改变甚至不改变语义的前提下,生成通顺而多变的文本。基于上述观察,本文在两个主流任务上比较了传统方法与 AMR 数据增强的效果,并分析了 AMR 方法的优势所在。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢