如何对齐是VSR中具有挑战的任务,光流方法和可变性卷积在中等运动的视频中具有显著优势,然而在处理大运动视频时会失效。本文通过非局部注意方式跳过对齐来融合相邻帧,在大运动视频上实现了SOTA。

- 作者单位:京东探索研究院

- 论文名称:Memory-Augmented Non-Local Attention for Video Super-Resolution

- 论文链接:https://arxiv.org/abs/2108.11048

- 代码链接:https://github.com/jiy173/MANA

看点

本文提出了一种内存增强非本地注意网络(MANA)。以前的方法主要利用相邻帧来辅助当前帧的超分。这些方法在空间帧对齐方面存在挑战,并且缺乏来自相邻帧的有用信息。相比之下,本文设计了一种跨帧非局部注意机制,允许视频在没有帧对齐的情况下实现超分,从而对视频中的大运动更加健壮。

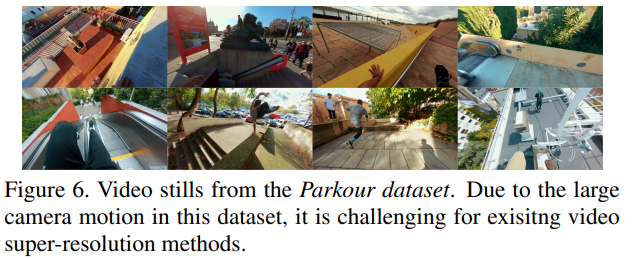

此外,为了获取相邻帧以外的一般先验信息,并补偿大运动造成的信息损失,本文设计了一种新的记忆增强注意模块,在训练中记忆一般视频细节。本文收集了Parkour数据集以验证MANA方法在大运动视频中的优越性。

动机

VSR主要有两个挑战:

- 第一个来自于视频的动态特性。由于帧间运动,融合前需要对相邻帧进行对齐,之前方法采用光流进行显式扭曲或可变形卷积学习隐式对齐。然而,它们高度依赖于相邻帧空间对齐的精度,很难胜任大运动视频。

- 第二个来自于LR中高频细节的不可逆丢失和有用信息的缺乏。大多数VSR方法试图融合来自相邻帧的信息进行重建。然而,获取的信息仍然有限,特别是大运动视频。在这种情况下,由于相邻帧的相似性降低,相关性变小,从而从本质上退化为SISR。

为了解决上述挑战,本文提出了一种内存增强非本地注意网络(MANA),它包含两个主要的模块。

- 跨帧非局部注意模块用来解决帧对齐问题。该模块允许在不与当前帧对齐的情况下融合相邻帧。传统的非局部注意计算q和k中每个像素之间的成对相关。然而,对所有空间位置的像素一视同仁是不合适的。由于连续性的性质,查询附近的像素会有更好的对应。为此,本文使用一个以q为中心的可训练高斯映射来对相关性进行加权,高斯加权跨帧非局部注意绕开了帧对齐操作。

- 为了解决相邻帧信息缺乏的问题,本文寻求融合现有视频之外的有用先验信息。这意味着网络在对训练集中的其他视频进行超分时要记住以前的经验。基于这一原理,本文在网络中引入了记忆增强注意模块。这个模块中拥有一个二维记忆库,它是在训练过程中学习到的。目的是总结整个训练集中具有代表性的局部细节,并将其作为当前超分的外部参考。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢