异质人脸识别旨在不同的领域进行人脸匹配,已被广泛应用于身份认证和安防监控等场景。异质人脸跨域差异大,异质数据对有限,面部属性变化大,是一个具有挑战性的问题。为了应对这些挑战,本文方法从异质数据增强的角度提出了一种新的异质人脸识别方法:身份-属性分离的面部合成。本文方法通过在五个HFR数据库上进行大量实验,证明FSIAD获得了比以前的HFR方法更好的性能。特别地,在迄今最大的HFR数据库LAMP-HQ上,FSIAD在VR@FAR=0.01%指标,比现有技术水平提高了4.8%。

论文地址:https://arxiv.org/pdf/2206.04854.pdf

背景与动机

异质人脸识别(Heterogeneous Face Recognition,HFR)在多媒体安全等许多实际应用中具有重要作用。HFR跨越不同的领域,如近红外、热红外和可见光。不同领域之间捕捉的图像的巨大差异降低了人脸识别性能,这就产生了对异质人脸识别的需求。当前异质人脸识别主要面临着三个挑战:(I)巨大的跨域差异:不同领域的人脸图像之间存在巨大差异,扩大了类内距离,提高了HFR的难度。(II)缺少异质的人脸数据:收集大规模异质人脸图像是费时又昂贵的。有限的受试者数量和小规模的HFR数据集容易导致过拟合问题。(III)面部属性变化大:人脸图像具有姿势、肤色、表情、光照等多种面部特征,进一步增加了类内距离,使人脸匹配更加困难。

之前的异质人脸识别方法主要集中在减少域的差异,但忽略了现实世界应用中面部属性的变化。基于以上,本文从异构数据增强的角度提出了一种新的异质人脸识别方法,创新点如下:

- 提出了身份-属性分离的人脸合成(FSIAD)框架,它通过数据增强解决了异质人脸识别的三个主要挑战,提高了异质人脸识别的性能。

- FSIAD包括身份-属性解耦(IAD)模块,将面部属性和身份从面部图像中分离出来。面部属性被限制为与身份正交,以减少它们之间的关联性。

- FSIAD包括人脸合成模块(FSM),它通过整合解耦的面部身份和属性来生成大规模的图像,以增强异质人脸识别数据库,并丰富面部属性的多样性。

方法介绍

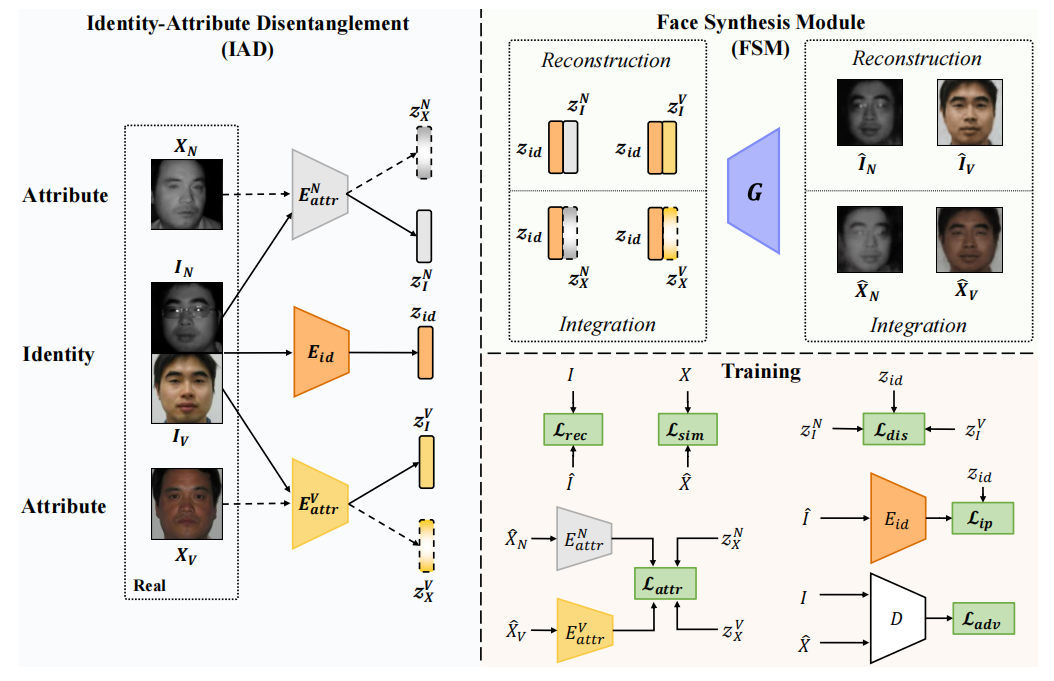

本文框架FSIAD由两个主要部分组成,身份-属性解耦模块(IAD)和面部合成模块(FSM)。如图1所示,给定成对的图像![]() 和

和![]() ,实线和虚线箭头分别表示I和X的处理流程。

,实线和虚线箭头分别表示I和X的处理流程。

图1 FSIAD框架

IAD模块

为了从人脸图像中提取身份特征,采用预先训练好的人脸识别模型LightCNN作为身份编码器![]() ,身份编码器

,身份编码器![]() 从I中提取身份表示

从I中提取身份表示![]() 。同时,属性编码器

。同时,属性编码器![]() 和

和![]() 从I和X中学习面部属性表示。

从I和X中学习面部属性表示。

IAD的训练分为两个步骤,特征解耦和分布学习。特征解耦的目的是减少身份和属性表示之间的相关性。因此,我们引入了一个在身份表示![]() 和属性表示

和属性表示![]() 之间的解耦目标

之间的解耦目标![]() :

:

第二步是属性分布学习。受VAEs的启发,通过最大化证据下限目标(ELBO)进行优化,具体如下:

其中,第一项表示![]() 的重建目标,第二项为近似后验分布

的重建目标,第二项为近似后验分布![]() 和先验分布

和先验分布![]() 之间的KL散度。定义分布学习目标最小化KL散度:

之间的KL散度。定义分布学习目标最小化KL散度:

简而言之,IAD的损失函数表述为:

其中,![]() 是一个可调节参数。

是一个可调节参数。

FSM模块

FSM的作用是通过结合已解耦的身份和属性特征合成图像。FSM的训练流程同时通过两个分支进行:重构和整合。除了与IAD共享的编码器![]() 、

、![]() 和

和![]() 外,FSM还包含一个生成器G和一个鉴别器D。

外,FSM还包含一个生成器G和一个鉴别器D。

重建

图像的身份特征和属性特征属于同一主体。生成器G通过身份特征和属性特征生成重构图像,并且,该重构图像![]() 应该与原始图像

应该与原始图像![]() 相同。因此,使用重构损失

相同。因此,使用重构损失![]() 来减少原始图像和重构图像之间的距离:

来减少原始图像和重构图像之间的距离:

通过整合I的身份特征和X的属性特征来合成图像,图像的身份特征和属性特征属于同一主体。为了保持合成图像的身份特征,我们从合成图像![]() 和

和![]() 中提取身份的特征表示,利用保持身份的目标损失

中提取身份的特征表示,利用保持身份的目标损失![]() 来增加身份表示之间的相似度:

来增加身份表示之间的相似度:

此外,合成图像的面部属性![]() 被期望与真实图像的面部属性

被期望与真实图像的面部属性![]() 相似。属性相似性目标

相似。属性相似性目标![]() 定义为:

定义为:

除了限制属性的相似度外,第二个分支还通过提高内容的相似性来保证性能。内容相似性可以从两个方面衡量:误差度量和结构相似性。当只受误差度量的约束时,网络倾向于生成目标图像的完整副本。同时,误差度量对视觉场景中包含对象关键结构特征的像素依赖性不敏感,这导致了对合成图像的感知质量较低。因此,采用多尺度结构相似度指数(MS-SSIM)作为结构相似度损失,以提高输入图像和合成图像之间的结构相似度。目标相似损失![]() 定义为:

定义为:

综上,第二分支整合的总损失![]() 定义如下:

定义如下:

为了进一步改进图像合成,生成器G以一种对抗性的方式进行了优化。通过施加一个鉴别器D来区分真实图像和G生成的合成图像,同时,生成器G试图生成真实的图像来混淆D。对抗损失![]() 表述为:

表述为:

FSM的损失函数![]() 定义为:

定义为:

本文方法FSIAD的总体损失总结为:

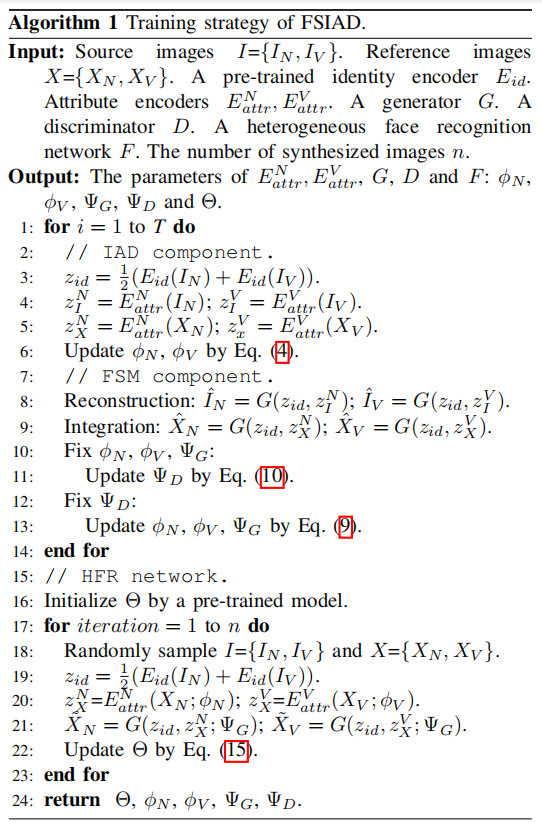

下图算法全面阐述了本文方法的工作流程:

实验

数据集

本文方法对5个异质人脸识别数据库进行了广泛的实验,包括CASIA NIR-VIS2.0、BUAA-VisNir、Oullu-CASIA NIR-VIS、TuftsFace和LAMP-HQ。

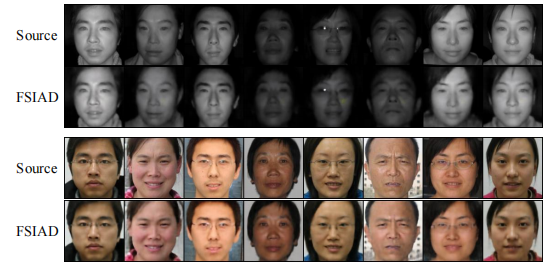

实验定性分析

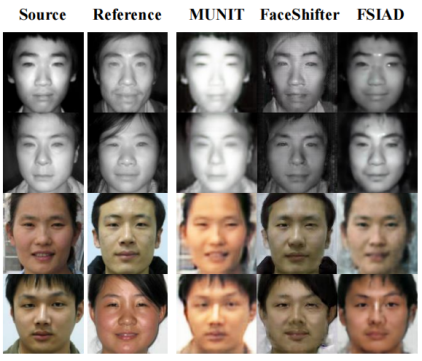

我们在CASIA NIR-VIS 2.0上进行了定性实验,并通过具有最先进性能的方法MUNIT和FaceShifter来评估FSIAD。

与这些方法相比,FSIAD在特征解耦和生成方面取得了更好的表现。首先,源图像的身份与其他面部属性被分离开来,在合成图像中得到很好的保留。另一方面,FSIAD可以很好地将身份与面部属性融合在一起,并防止出现人工痕迹和粗糙的纹理。此外,面部属性如表情、姿势和肤色也从参考图像转移到生成的图像中。

为了进一步分析,我们将重构和整合的结果可视化,以证明所提出方法FSIAD的能力。图4显示,重构图像质量高,图像逼真。

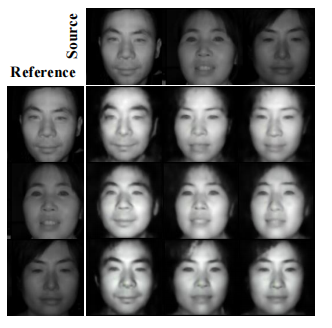

如图5所示,第一行和第一列的图像分别是源图像和参考图像。其余的图像由FSIAD合成,具有源图像的身份和参考图像的属性。合成的结果保持了源图像的身份,与参考图像具有相似的面部属性。

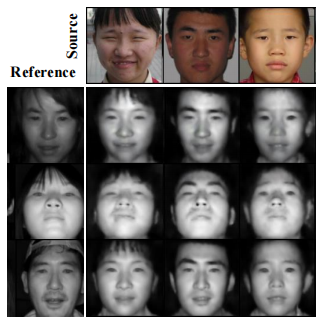

图6 跨域合成的可视化结果

如图6,FSIAD也适用于跨域合成,在特征解耦和人脸生成方面具有显著的能力。在这里需要注意的是,源图像和参考图像不仅来自不同的主题,而且属于不同的光谱域,这增加了人脸合成的难度。

实验定量分析

对图像合成的定量评价

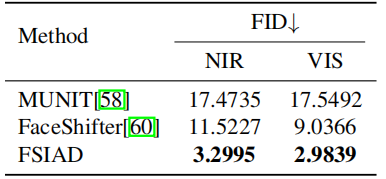

表1 在CASIA NIR-VIS 2.0数据集上真实图像的分布与不同方法生成的合成图像之间的FID距离

如表1所示,FID是一种测量真实图像与合成图像分布之间距离的度量方法。与MUNIT和FaceShifter相比,本文方法FSIAD取得了最佳的FID值,更倾向于生成真实和高质量的图像来进行人脸增强。

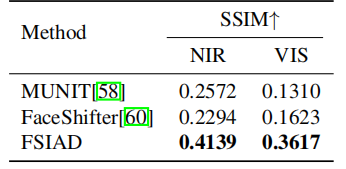

表2 CASIA NIR-VIS 2.0数据集的属性相似性的定量结果

SSIM度量图像之间结构信息的相似性,SSIM得分越高,表明合成图像的面部属性与真实图像更相似。如表2所示,FSIAD的性能优于最先进的方法,并且在特征解耦方面拥有最好的能力。

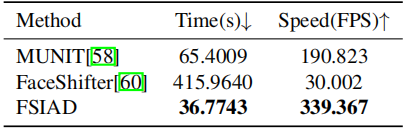

表3 不同方法的时间和速度

通过测量表3中各个方法合成12,480对图像所需要消耗的时间,从而进一步评估上述方法的效率。每秒帧数(FPS)分数等于合成图像的数量与合成图像所花费的时间的比率。如表3所示,本文方法FSIAD是最有效的方法。

异质人脸识别实验

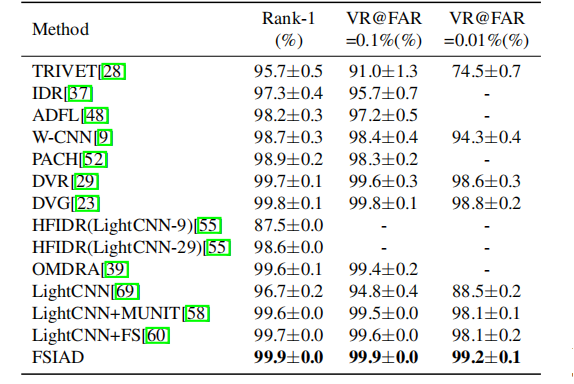

为了验证FSIAD对异质人脸识别的有效性,在5个HFR数据库上进行了广泛的实验,包括CASIA NIR-VIS 2.0, BUAA-VisNir, Oulu-CASIA NIR-VIS, Tufts Face and LAMP-HQ。同时,选取先进的方法进行比较,包括TRIVET, IDR, ADFL, W-CNN, PACH, DVR, DVG, HFIDR, and OMDRA。

表4 在CASIA NIR-VIS 2.0 DATABASE上进行10折实验的结果

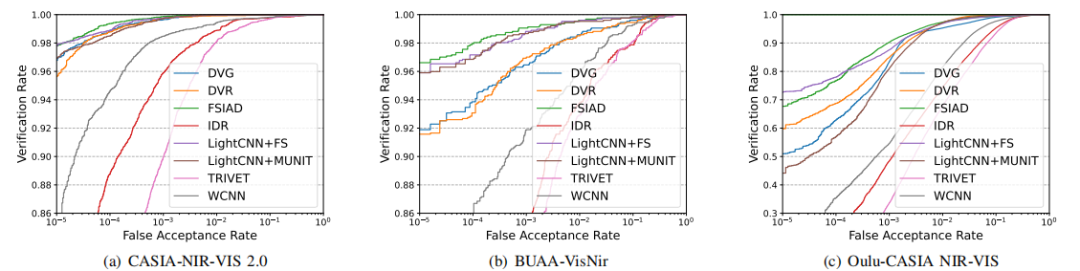

图7 不同方法在CASIA-NIR-VIS 2.0, BUAA-VisNir, and Oulu-CASIA NIR-VIS数据集上的ROC曲线

以CASIA NIR-VIS 2.0为例,如表4所示,在CASIA NIR-VIS 2.0进行了10折交叉验证。表4和图7 (a)实验结果表明,本文方法FSIAD有效地解决了HFR的挑战,促进了HFR的性能。

消融实验

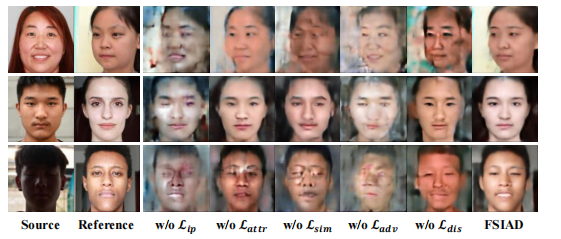

图8 LAMP-HQ数据库中消融实验的定性结果

如图8,对于消融实验,构建了五个变体,每个变体取消特定的损失函数。与变体相比,FSIAD利用了本文提出的损失函数,成功地通过身份表示和面部属性表示的组合生成了高质量的面部。FSIAD的合成面具有光滑的纹理,一致的轮廓,同时没有噪声或伪影。因此,定性消融实验表明,所有提出的损失函数对于FSIAD产生高质量的面和实现异质面增强是必不可少的。

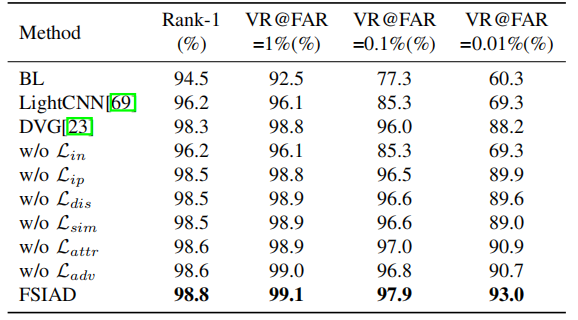

表5 在LAMP-HQ上进行的消融实验的定量结果

如表5所示,只有当所有提出的损失函数被激活时,FSIAD才能发挥其最佳性能,达到最佳效果。综上,定量和定性分析表明,FSIAD中提出的所有损失函数都是不可缺少的,它们共同监督FSIAD产生高质量的异质面孔,促进HFR的性能。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢